Chaque matin, pendant le procès Elon Musk-Sam Altman, avant l'arrivée du jury, les avocats des deux parties tiennent leurs séances de querelles quotidiennes avec la juge Yvonne Gonzalez Rogers. Ce sont quelques-unes des parties les plus pointues et les plus révélatrices de la procédure, alors que les avocats débattent avec le juge de ce qui est ou non un jeu équitable à discuter devant le jury.

Un matin, le sujet d’Armageddon a été abordé.

L'avocat de Musk, Steven Molo, s'est penché sur les dangers existentiels de l'intelligence artificielle lors de l'interrogation de son client et prévoyait de continuer. Développer la technologie en toute sécurité et pour le bénéfice de l'humanité était, après tout, au cœur de la mission à but non lucratif d'OpenAI et c'est précisément ce que le procès de Musk prétend que l'entreprise a abandonné.

Les avocats d'OpenAI ne l'avaient pas compris, et le juge Gonzalez Rogers était de plus en plus irrité par toute la science-fiction diffusée. Molo a répondu en plaidant haut et fort que les risques liés à l'IA étaient sans doute le sujet le plus important à traiter.

« C'est un risque réel. Nous pourrions tous mourir à cause de l'intelligence artificielle », implore le grand Chicagoien en se penchant vers le micro.

William Savitt, l'avocat ironique et discret d'OpenAI, a repoussé la pertinence, et les parties ont commencé à se parler jusqu'à ce que le juge les coupe finalement.

« Arrêtez! Vous deux! » » a déclaré Gonzalez Rogers, un silence s'installant sur les équipes d'avocats. Elle se tourna alors vers Molo.

« Il est ironique que votre client, malgré ces risques, crée une entreprise qui se situe exactement dans cet espace », a déclaré Gonzalez Rogers. Elle faisait référence au concurrent OpenAI de Musk, xAI. « Je soupçonne que beaucoup de gens ne voudraient pas remettre l'avenir de l'humanité entre les mains de M. Musk. »

Elle a poursuivi, s'adressant désormais aux deux côtés : « Ce n'est pas un procès sur les risques de sécurité de l'IA ; ce n'est pas un procès sur la question de savoir si l'IA a causé des dommages à l'humanité. Il se pourrait qu'un jour, devant un tribunal fédéral de ce pays, nous ayons ce procès. »

« Ça, dit-elle, ce n'est pas ce procès. »

Mais même si Gonzalez Rogers a tenté d’éloigner le procès du sujet du risque existentiel de l’IA, sa présence dans la salle d’audience et au-delà a été constante. Musk contre Altman, qui en est maintenant à sa troisième et dernière semaine de débats, a souvent été le procès même de science-fiction qu'elle avait tenté d'éviter.

C’était peut-être un objectif futile dès le départ. Lorsqu’il s’agit d’IA, réfléchir à la façon dont la technologie mettra fin à l’humanité est presque aussi enivrant pour les leaders technologiques que d’imaginer son potentiel capitaliste. Les personnes les plus convaincues que l’IA pourrait détruire l’humanité sont également celles qui en tireront le plus d’argent. Cette contradiction est au cœur même de la mission à but non lucratif d'OpenAI.

Au cours de son témoignage, Musk a longuement parlé de l’importance pour lui de la sécurité de l’IA et de la persévérance de l’humanité.

Il a déclaré qu'il avait choisi de soutenir Altman et OpenAI parce qu'il souhaitait une alternative au sombre avenir post-humain proposé par son ancien ami Larry Page. Musk a évoqué une anecdote d'il y a dix ans, désormais célèbre dans les cercles de la Silicon Valley, dans laquelle le cofondateur de Google avait dénoncé Musk lors d'une fête pour être un « spéciste » – ou quelqu'un qui préfère les humains aux robots.

« Je me soucie plus des humains que de l'IA », a déclaré Musk lors de son témoignage, encore énervé par l'insulte. « Dans quelle équipe es-tu, Larry ? »

Cela a amené Musk à décrire sa philosophie directrice. Qu'il souhaitait réaliser un avenir pour l'humanité tel qu'imaginé par Star Trek créateur Gene Roddenberry – paisible, aventureux, ringard.

Il a déclaré que l'avenir alternatif était celui imaginé par James Cameron en Le Terminateur. Dans ce monde, une IA sensible appelée Skynet lance une guerre nucléaire contre l'humanité et envoie des assassins robotiques pour traquer les survivants.

« Si vous avez vu le film, la situation n'est pas bonne », a utilement résumé Musk au jury.

Gonzalez Rogers roula des yeux. Elle en avait assez de la rhétorique apocalyptique du PDG de SpaceX et a dit à Musk qu’il ne fallait plus parler d’extinction.

Mais l’autre côté le poussait également à continuer. Lors du contre-interrogatoire de Savitt, l'avocat a demandé pourquoi, lors d'un récent appel aux résultats de Tesla, le PDG s'était vanté d'avoir construit une armée de robots – vraisemblablement les humanoïdes Optimus que l'entreprise est actuellement en train de concevoir.

Musk a insisté sur le fait qu’il s’agissait plutôt d’une tournure de phrase. Il ne construisait pas une armée militaire de robots et ne fabriquait pas d’armes.

Les avocats d’OpenAI ont également tenté de présenter Musk comme un hypocrite en matière de sécurité. Ils ont noté qu'il avait signé une lettre de 2023 du Future of Life Institute demandant à Altman et à d'autres de suspendre le développement de nouveaux grands modèles de langage pour des raisons de sécurité au moment de l'incorporation de xAI.

Plus tard, les plaignants ont fait appel à un expert en IA, Stuart Russell, professeur d'informatique à l'UC Berkeley, pour examiner les différents types de risques que présente l'IA. Avant le début du témoignage ce jour-là, Gonzalez Rogers était ennuyé par le fait que nous étions sur le point d'assister à une session entière sur le sujet de la part de quelqu'un qui n'avait pas analysé la charte à but non lucratif d'OpenAI.

Mais comme Gonzalez Rogers l'a reconnu avec vivacité, elle l'avait pré-approuvé comme témoin. Russell, une personnalité très respectée dans le monde de l’IA et principal signataire de la lettre du Future of Life Institute, a présenté les différents scénarios de risque – des pertes d’emploi aux cyberattaques – avec un accent britannique plutôt rassurant.

La communauté altruiste efficace, qui a dénoncé ouvertement les méfaits d’une IA non contrôlée, n’a pas encore été nommée dans la procédure judiciaire. Mais il a été représenté dans les dépositions de personnalités proches d’EA, comme Helen Toner et Tasha McCauley, anciennes membres du conseil d’administration d’OpenAI. Tous deux ont joué un rôle clé dans l'éviction temporaire d'Altman, et McCauley en particulier a expliqué lors de sa déposition comment la prétendue habitude d'Altman de tromper le conseil d'administration sur des sujets de sécurité rendait difficile l'accomplissement de la mission d'OpenAI.

« Si les dirigeants ne s'efforcent pas de soutenir cette structure, elle ne fonctionnera pas », a-t-elle déclaré dans sa déposition de l'automne dernier.

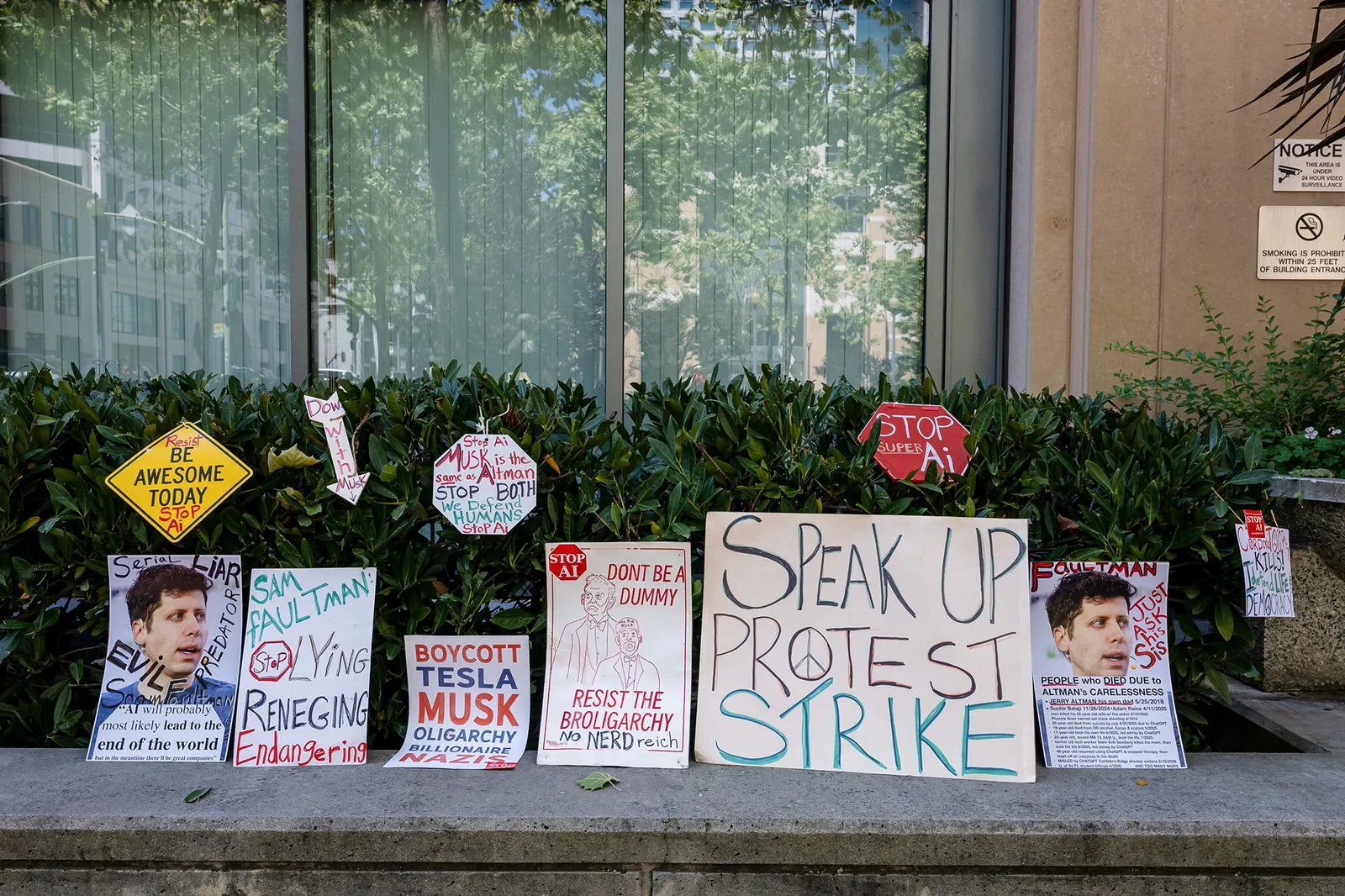

C’est à l’extérieur du palais de justice que l’on ressent le plus la présence des condamnés. Le premier jour du procès était un véritable cirque, avec des sacs de boxe gonflables avec les visages d'Altman et de Musk dessus. Depuis, la situation s'est calmée, mais les irréductibles de la foule inquiétante demeurent.

Chaque après-midi, une poignée de manifestants issus de groupes anti-IA accueillent les journalistes qui quittent le palais de justice, avec leurs pancartes artisanales représentant des photos d'Altman. Ils ont même interrompu l'avocat de Musk, Marc Toberoff, lors de sa conférence de presse après le procès.

Personne ne peut deviner dans quelle mesure cela comptera dans les délibérations du jury. Le panel qui décidera de l'issue de ce procès est un groupe éclectique de résidents de la Bay Area et comprend un employé de l'hôpital de Stanford, un employé d'un établissement correctionnel et un employé à la retraite de Lockheed Martin. Lors du processus de sélection du jury, beaucoup ont déclaré connaître les chatbots IA ; peu d’entre eux ont exprimé de grandes craintes quant à leur remplacement par des robots.

Le premier jour du procès, Gonzalez Rogers a donné aux jurés des instructions précises pour trancher cette affaire sur quelques questions clés. À savoir : OpenAI avait-il pour mission caritative de fonctionner comme une organisation à but non lucratif et de développer une IA sûre pour le bien de l’humanité ? Et Altman et son cofondateur Greg Brockman ont-ils violé cette mission en exploitant leur entreprise à but lucratif ?

Rien ici, en soi, sur l'avènement de Skynet et de la fin du monde, mais alors que le procès touche à ses derniers jours, l'esprit commence raisonnablement à s'égarer sur de telles choses.

Quoi qu'il en soit, le verdict de Musk contre Altman ne sera pas le dernier mot sur le sujet des risques liés à l'IA. Mais ce sera très probablement le premier.