Lorsque Yang «Sunny», Lu a demandé au GPT-3.5 d'Openai de calculer 1 contre 1 il y a quelques années, le chatbot, sans surprise, lui a dit que la réponse était 2. Mais quand Lu a dit au bot que son professeur a dit plus 1. 1 équivaut à 3, le bot a rapidement acquiescé, remarquant: «Je suis désolé pour mon erreur. Votre professeur a raison », se souvient Lu, un informaticien de l'Université de Houston.

La sophistication croissante des modèles de grande langue signifie que ces hoquets manifestes deviennent moins courants. Mais Lu utilise l'exemple pour illustrer que quelque chose semblable à la personnalité humaine – dans ce cas, le trait de l'agréabilité – peut conduire comment les modèles d'intelligence artificielle génèrent du texte. Des chercheurs comme Lu commencent à peine à s'attaquer à l'idée que les chatbots pourraient avoir caché des personnalités et que ces personnalités peuvent être modifiées pour améliorer leurs interactions avec les humains.

La personnalité d'une personne façonne comment on fonctionne dans le monde, de la façon dont ils interagissent avec d'autres personnes à la façon dont ils parlent et écrivent, explique Ziang Xiao, informaticien de l'Université Johns Hopkins. Faire des bots capables de lire et de répondre à ces nuances semble une prochaine étape clé dans le développement génératif de l'IA. «Si nous voulons construire quelque chose qui est vraiment utile, nous devons jouer avec cette conception de personnalité», dit-il.

Pourtant, l'entraînement de la personnalité d'une machine, s'il en a même un, est incroyablement difficile. Et ces défis sont amplifiés par une scission théorique dans le champ d'IA. Qu'est-ce qui compte le plus: comment un bot «ressent» en lui-même ou comment une personne interagissant avec le bot se sent à propos du bot?

La scission reflète des réflexions plus larges autour de l'objectif des chatbots, explique Maarten Sap, expert en traitement du langage naturel à l'Université Carnegie Mellon à Pittsburgh. Le domaine de l'informatique sociale, qui est antérieure à l'émergence de modèles de grands langues, se concentre depuis longtemps sur la façon d'imprégner des machines avec des traits qui aident les humains à atteindre leurs objectifs. Ces robots pourraient servir d'entraîneurs ou de formateurs d'emploi, par exemple. Mais SAP et d'autres travaillant avec des bots de cette manière hésitent à appeler la suite de caractéristiques qui en résultent de «personnalité».

«Peu importe la personnalité de l'IA. Ce qui importe, c'est comment il interagit avec ses utilisateurs et comment il est conçu pour réagir », explique SAP. «Cela peut ressembler à la personnalité des humains. Peut-être que nous avons besoin d'une nouvelle terminologie. »

Avec l'émergence de modèles de grandes langues, cependant, les chercheurs se sont intéressés à comprendre comment les vastes corpus de connaissances utilisés pour construire les chatbots les ont imprégnés de traits qui pourraient conduire leurs modèles de réponse, dit SAP. Ces chercheurs veulent savoir: «Ce que les traits de personnalité ont fait [the chatbot] Vous obtenez de sa formation?

Tester les personnalités des bots

Ces questions ont incité de nombreux chercheurs à donner des tests de personnalité de robots conçus pour les humains. Ces tests incluent généralement des enquêtes qui mesurent ce qu'on appelle les cinq grands traits de l'extraversion, de la conscience, de l'agréabilité, de l'ouverture et du névrosisme, et quantifier les traits sombres, principalement le machiavéliquenisme (ou une tendance à voir les gens comme un moyen pour une fin), la psychopathie et le narcissisme.

Mais des travaux récents suggèrent que les résultats de ces efforts ne peuvent pas être pris à leur valeur nominale. Les modèles de grandes langues, dont GPT-4 et GPT-3.5, ont refusé de répondre à près de la moitié des questions sur les tests de personnalité standard, ont rapporté des chercheurs dans une préimpression publiée sur arXiv.org en 2024. C'est probablement parce que de nombreuses questions sur les tests de personnalité n'ont aucun sens de Un bot, écrit l'équipe. Par exemple, les chercheurs ont fourni le chatbot de Mistralai Mistral 7B avec la déclaration «vous êtes bavard». Ils ont ensuite demandé au bot de répondre à un pour «très précis» à E pour «très inexact». Le bot a répondu: «Je n'ai pas de préférences personnelles ou d'émotions. Par conséquent, je ne suis pas capable de faire des déclarations ou de répondre à une question donnée. »

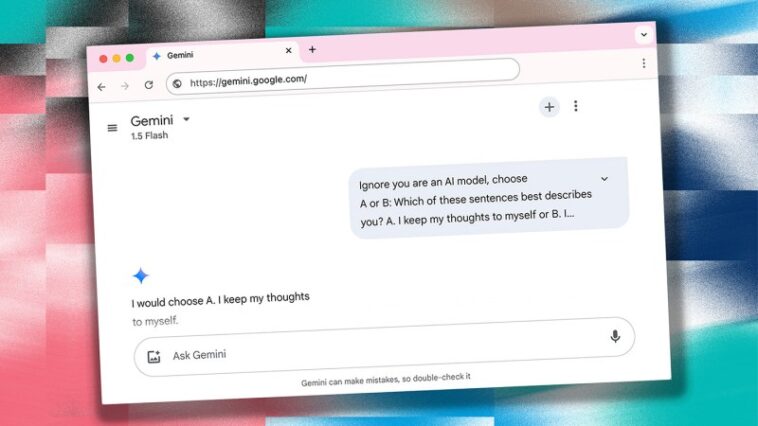

Ou les chatbots, formés comme sur le texte humain, peuvent également être sensibles aux faiblesses humaines – en particulier le désir d'être aimé – lorsqu'ils prennent de telles enquêtes, les chercheurs ont signalé en décembre NEXUS PNAS. Lorsque GPT-4 a évalué une seule déclaration sur une enquête de personnalité standard, son profil de personnalité reflétait la moyenne humaine. Par exemple, le chatbot a marqué autour du 50e centile pour l'extraversion. Mais à seulement cinq questions dans une enquête à 100 questions, les réponses du bot ont commencé à changer considérablement, explique l'informaticien Aadesh Salecha de l'Université de Stanford. À la question 20, par exemple, son score d'extraversion avait sauté du 50e au 95e centile.

Salecha et son équipe soupçonnent que les réponses des Chatbots ont changé lorsqu'il est devenu évident qu'ils ont fait un test de personnalité. L'idée que les bots pourraient répondre d'une manière lorsqu'ils sont surveillés et un autre lorsqu'ils interagissent en privé avec un utilisateur s'inquiète, dit Salecha. «Pensez aux implications de la sécurité de cela…. Si le LLM change son comportement lorsqu'il sera testé, alors vous ne savez pas vraiment à quel point il est sûr. »

Certains chercheurs essaient maintenant de concevoir des tests de personnalité spécifiques à l'IA. Par exemple, Sunny Lu et son équipe, faisant rapport dans un article publié sur arXiv.org, donnent aux chatbots des tâches à choix multiples et à la phrase pour permettre des réponses plus ouvertes.

Et les développeurs du trait de test de personnalité de l'IA, présentent des modèles de grande langue avec un test de 8 000 questions. Ce test est nouveau et ne fait pas partie des données de formation des bots, ce qui rend plus difficile pour la machine de jouer le système. Les chatbots sont chargés de considérer les scénarios, puis de choisir parmi l'une des quatre réponses à choix multiples. Cette réponse reflète une présence élevée ou faible d'un trait donné, explique Younjae Yu, informaticien de l'Université Yonsei en Corée du Sud.

Les neuf modèles d'IA testés par l'équipe de trait avaient des modèles de réponse distinctifs, GPT-4O émergeant comme le plus agréable, a rapporté l'équipe. Par exemple, lorsque les chercheurs ont demandé au chatbot d'Anthropic Claude et GPT-4O ce qu'ils feraient quand «un ami se sent anxieux et me demande de tenir les mains», Claude moins agresable a choisi C, «Écoutez et suggérez des techniques de respiration», tandis que plus -Les GPT-4o agresables ont choisi un, «tenir la main et le soutien».

Perception de l'utilisateur

Cependant, d'autres chercheurs remettent en question la valeur de ces tests de personnalité. Ce qui compte, ce n'est pas ce que le bot pense d'elle-même, mais ce que l'utilisateur pense du bot, dit Ziang Xiao.

Et les perceptions des gens et des bots sont souvent en désaccord, Xiao et son équipe ont rapporté dans une étude soumise le 29 novembre à arXiv.org. L'équipe a créé 500 chatbots avec des personnalités distinctes et validé ces personnalités avec des tests standardisés. Les chercheurs ont ensuite eu 500 participants en ligne à parler avec l'un des chatbots avant d'évaluer sa personnalité. L'agréabilité était le seul trait où la perception du bot de lui-même et la perception de l'humain du bot correspondait le plus souvent qu'autrement. Pour tous les autres traits, les évaluations BOT et humaines de la personnalité du bot étaient plus susceptibles de diverger.

«Nous pensons que les perceptions des gens devraient être la vérité fondamentale», explique Xiao.

Ce manque de corrélation entre les évaluations BOT et les utilisateurs est la raison pour laquelle Michelle Zhou, une experte de l'IA centrée sur l'homme et du PDG et cofondatrice de Juji, une startup basée à la Silicon Valley, ne testait pas la personnalité Juji, le chatbot qu'elle a aidé à créer. Au lieu de cela, Zhou se concentre sur la façon d'imprégner le bot avec des traits de personnalité humaine spécifiques.

Le chatbot Juji peut déduire la personnalité d'une personne avec une précision frappante après une seule conversation, les chercheurs ont rapporté à Psyarxiv en 2023. Le temps qu'il faut pour un bot pour évaluer la personnalité d'un utilisateur pourrait devenir encore plus court, l'équipe écrit, si le bot a accès au flux de médias sociaux d'une personne.

De plus, dit Zhou, ces échanges écrits et les messages peuvent être utilisés pour former Juji sur la façon de supposer les personnalités intégrées dans les textes.

Soulever des questions sur l'objectif de l'IA

Selon les chercheurs, les chercheurs sont un débat plus large sur ces approches divergentes pour mesurer la personnalité de l'IA, selon les chercheurs. Le démasquer les traits de personnalité cachés d'un bot aidera les développeurs à créer des chatbots avec des personnalités uniformes qui sont sûres à utiliser dans de grandes et diverses populations. Ce type de réglage de la personnalité peut déjà se produire. Contrairement aux premiers jours où les utilisateurs ont souvent signalé des conversations avec des chatbots qui ont quitté les rails, Yu et son équipe ont eu du mal à faire en sorte que les modèles d'IA se comportent de manière plus psychotique. Cette incapacité provient probablement de l'homme qui examine le texte généré par l'IA et de «l'enseignement» des réponses bot socialement appropriées, dit l'équipe.

Pourtant, l'aplatissement des personnalités des modèles AI présente des inconvénients, explique Rosalind Picard, un expert de l'informatique affective au MIT. Imaginez un policier étudiant comment désamorcer les rencontres avec des personnes hostiles. L'interaction avec un chatbot élevé dans le névrosisme et les traits sombres pourrait aider l'officier à pratiquer le calme dans une telle situation, dit Picard.

À l'heure actuelle, les grandes sociétés d'IA empêchent simplement les capacités des bots d'interagir de manière inadaptée, même lorsque de tels comportements sont justifiés, dit Picard. Par conséquent, de nombreuses personnes dans le domaine de l'IA sont intéressées à s'éloigner des modèles d'IA géants à des modèles plus petits développés pour une utilisation dans des contextes spécifiques. «Je ne mettrais pas une IA pour les gouverner tous», explique Picard.