Le processus de découverte de molécules qui ont les propriétés nécessaires pour créer de nouveaux médicaments et de nouveaux matériaux sont lourds et coûteux, consommant de vastes ressources de calcul et des mois de travail humain pour réduire l'espace énorme des candidats potentiels.

Les modèles de grands langues (LLM) comme Chatgpt pourraient rationaliser ce processus, mais permettant à un LLM de comprendre et de raisonner sur les atomes et les liaisons qui forment une molécule, de la même manière que les mots qui forment des phrases, ont présenté une pierre d'achoppement scientifique.

Des chercheurs du MIT et du MIT-IBM Watson AI Lab ont créé une approche prometteuse qui augmente un LLM avec d'autres modèles d'apprentissage machine appelés modèles basés sur des graphiques, qui sont spécialement conçus pour générer et prédire les structures moléculaires.

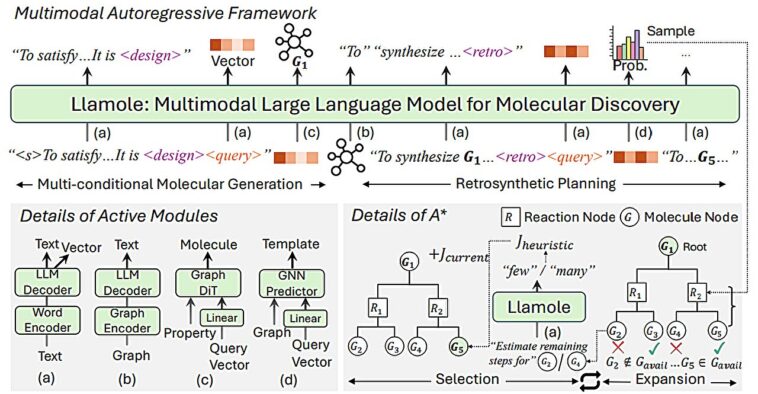

Leur méthode utilise un LLM de base pour interpréter les requêtes en langage naturel spécifiant les propriétés moléculaires souhaitées. Il bascule automatiquement entre la base LLM et les modules AI basés sur des graphiques pour concevoir la molécule, expliquer la justification et générer un plan étape par étape pour le synthétiser. Il entrelace du texte, du graphique et de la génération d'étape de synthèse, combinant des mots, des graphiques et des réactions dans un vocabulaire commun pour que le LLM consomme.

Par rapport aux approches basées sur LLM existantes, cette technique multimodale a généré des molécules qui correspondaient mieux aux spécifications de l'utilisateur et étaient plus susceptibles d'avoir un plan de synthèse valide, améliorant le rapport de réussite de 5% à 35%.

Il a également surclassé les LLM qui sont plus de 10 fois sa taille et que les molécules de conception et les voies de synthèse uniquement avec des représentations basées sur le texte, suggérant que la multimodalité est la clé du succès du nouveau système.

« This could hopefully be an end-to-end solution where, from start to finish, we would automate the entire process of designing and making a molecule. If an LLM could just give you the answer in a few seconds, it would be a huge time-saver for pharmaceutical companies, » says Michael Sun, an MIT graduate student and co-author of a paper on this technique posted to the arxiv serveur de préimprimée.

Les co-auteurs de Sun incluent l'auteur principal Gang Liu, étudiant diplômé à l'Université de Notre Dame; Wojciech Matusik, professeur de génie électrique et informatique au MIT qui dirige le groupe de conception et de fabrication informatique au sein du laboratoire d'intelligence informatique et de l'intelligence artificielle (CSAIL); Meng Jiang, professeur agrégé à l'Université de Notre Dame; et l'auteur principal Jie Chen, chercheur principal et directeur du MIT-IBM Watson AI Lab.

La recherche sera présentée à la Conférence internationale sur les représentations de l'apprentissage (ICLR 2025) tenue à Singapour du 24 au 28 avril.

Meilleur des deux mondes

Les modèles de grands langues ne sont pas conçus pour comprendre les nuances de la chimie, ce qui est une des raisons pour lesquelles ils luttent avec la conception moléculaire inverse, un processus d'identification des structures moléculaires qui ont certaines fonctions ou propriétés.

Les LLMS convertissent le texte en représentations appelées jetons, qu'ils utilisent pour prédire séquentiellement le mot suivant d'une phrase. Mais les molécules sont des «structures graphiques», composées d'atomes et de liaisons sans ordre particulier, ce qui les rend difficiles à coder en tant que texte séquentiel.

D'un autre côté, des modèles AI basés sur des graphiques puissants représentent des atomes et des liaisons moléculaires en tant que nœuds et bords interconnectés dans un graphique. Bien que ces modèles soient populaires pour la conception moléculaire inverse, ils nécessitent des entrées complexes, ne peuvent pas comprendre le langage naturel et donner des résultats qui peuvent être difficiles à interpréter.

Les chercheurs du MIT ont combiné un LLM avec des modèles d'IA basés sur des graphiques dans un cadre unifié qui tire le meilleur des deux mondes.

Llamole, qui signifie un modèle de grande langue pour la découverte moléculaire, utilise un LLM de base comme gardien pour comprendre la requête d'un utilisateur – une demande de langue simple pour une molécule avec certaines propriétés.

Par exemple, peut-être qu'un utilisateur cherche une molécule qui peut pénétrer la barrière hémato-encéphalique et inhiber le VIH, étant donné qu'il a un poids moléculaire de 209 et certaines caractéristiques de liaison.

Comme le LLM prédit le texte en réponse à la requête, il bascule entre les modules de graphique.

Un module utilise un modèle de diffusion graphique pour générer la structure moléculaire conditionnée aux exigences d'entrée. Un deuxième module utilise un réseau de neurones graphiques pour coder la structure moléculaire générée en jetons pour que les LLMS puissent consommer. Le module graphique final est un prédicteur de réaction de graphique qui prend en entrée une structure moléculaire intermédiaire et prédit une étape de réaction, à la recherche de l'ensemble exact d'étapes pour fabriquer la molécule à partir de blocs de construction de base.

Les chercheurs ont créé un nouveau type de jeton de déclenchement qui indique au LLM quand activer chaque module. Lorsque le LLM prédit un jeton de déclenchement « Design », il passe au module qui esquisse une structure moléculaire, et lorsqu'il prédit un jeton de déclenchement « rétro », il passe au module de planification rétrosynthétique qui prédit l'étape de réaction suivante.

« La beauté de cela est que tout ce que le LLM génère avant d'activer un module particulier est introduit dans ce module lui-même. Le module apprend à fonctionner d'une manière cohérente avec ce qui a précédé », dit Sun.

De la même manière, la sortie de chaque module est codée et renvoyée dans le processus de génération du LLM, il comprend donc ce que chaque module a fait et continuera de prédire les jetons en fonction de ces données.

Structures moléculaires meilleures et plus simples

En fin de compte, Llamole produit une image de la structure moléculaire, une description textuelle de la molécule et un plan de synthèse étape par étape qui fournit les détails de la façon de le faire, des réactions chimiques individuelles.

Dans des expériences impliquant la conception de molécules qui correspondent aux spécifications de l'utilisateur, Llamole a surpassé 10 LLMS standard, quatre LLM à réglage fin et une méthode spécifique au domaine de pointe. Dans le même temps, il a porté le taux de réussite de la planification rétrosynthétique de 5% à 35% en générant des molécules de meilleure qualité, ce qui signifie qu'ils avaient des structures plus simples et des blocs de construction à moindre coût.

« À eux seuls, les LLM ont du mal à comprendre comment synthétiser les molécules car elle nécessite beaucoup de planification en plusieurs étapes. Notre méthode peut générer de meilleures structures moléculaires qui sont également plus faciles à synthétiser », explique Liu.

Pour former et évaluer Llamole, les chercheurs ont construit deux ensembles de données à partir de zéro, car les ensembles de données existants des structures moléculaires ne contenaient pas suffisamment de détails. Ils ont augmenté des centaines de milliers de molécules brevetées avec des descriptions de langage naturel générées par l'AI et des modèles de description personnalisés.

L'ensemble de données qu'ils ont construit pour affiner le LLM comprend des modèles liés à 10 propriétés moléculaires, donc une limitation du llamole est qu'elle est formée pour concevoir des molécules en considérant uniquement ces 10 propriétés numériques.

Dans les travaux futurs, les chercheurs souhaitent généraliser Llamole afin qu'il puisse incorporer n'importe quelle propriété moléculaire. De plus, ils prévoient d'améliorer les modules de graphe pour augmenter le taux de réussite de la rétrosynthèse de Llamole.

Et à long terme, ils espèrent utiliser cette approche pour aller au-delà des molécules, créant des LLM multimodales qui peuvent gérer d'autres types de données basées sur des graphiques, telles que des capteurs interconnectés dans un réseau électrique ou des transactions sur un marché financier.

« Llamole démontre la faisabilité de l'utilisation de modèles de langage grand comme interface à des données complexes au-delà de la description textuelle, et nous prévoyons qu'ils sont un fondement qui interagit avec d'autres algorithmes d'IA pour résoudre tout problème de graphique », explique Chen.