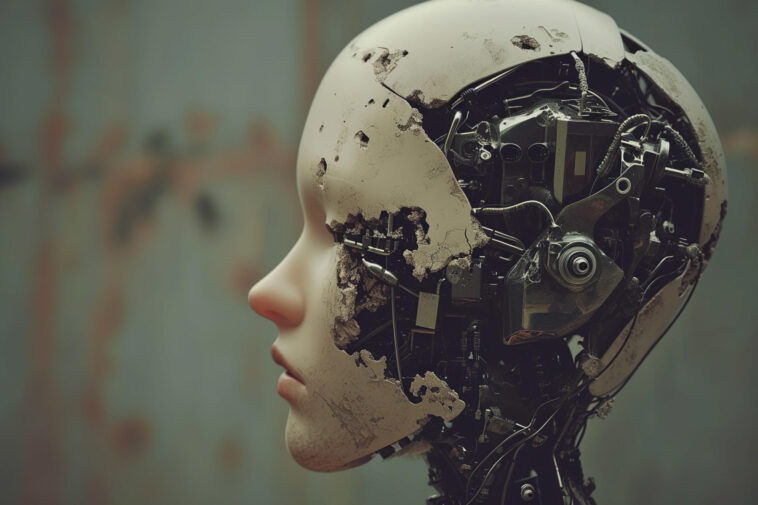

Des chercheurs de l’Université de Copenhague ont prouvé que des algorithmes d’apprentissage automatique totalement stables sont inaccessibles pour des problèmes complexes, soulignant la nécessité cruciale de tests approfondis et d’une prise de conscience des limites de l’IA. Crédit : Issues.fr.com

Des chercheurs de l’Université de Copenhague sont devenus les premiers au monde à prouver mathématiquement qu’au-delà de simples problèmes, il est impossible de développer des algorithmes d’IA qui seront toujours stables.

ChatGPT et similaire apprentissage automatiqueles technologies basées sur la technologie sont en plein essor. Cependant, même les algorithmes les plus avancés sont confrontés à des limites. Des chercheurs de l’Université de Copenhague ont fait une découverte révolutionnaire, démontrant mathématiquement qu’au-delà des problèmes fondamentaux, il est impossible de développer des algorithmes d’IA toujours stables. Cette recherche pourrait ouvrir la voie à des protocoles de test améliorés pour les algorithmes, mettant en évidence les différences inhérentes entre le traitement automatique et l’intelligence humaine.

L’article scientifique décrivant le résultat a été approuvé pour publication lors de l’une des principales conférences internationales sur l’informatique théorique.

Les machines interprètent les images médicales avec plus de précision que les médecins, traduisent les langues étrangères et pourraient bientôt être capables de conduire des voitures avec plus de sécurité que les humains. Cependant, même les meilleurs algorithmes présentent des faiblesses. Une équipe de recherche du Département d’informatique de l’Université de Copenhague tente de les révéler.

Prenons l’exemple d’un véhicule automatisé lisant un panneau routier. Si quelqu’un a apposé un autocollant sur le panneau, cela ne distraira pas le conducteur humain. Mais une machine peut facilement être retardée parce que le signe est désormais différent de ceux sur lesquels elle a été formée.

« Nous aimerions que les algorithmes soient stables dans le sens où si l’entrée est légèrement modifiée, la sortie restera presque la même. La vraie vie implique toutes sortes de bruits que les humains ont l’habitude d’ignorer, alors que les machines peuvent être confuses », explique le professeur Amir Yehudayoff, qui dirige le groupe.

Un langage pour discuter des faiblesses

En tant que premier au monde, le groupe, en collaboration avec des chercheurs d’autres pays, a prouvé mathématiquement qu’en dehors de problèmes simples, il n’est pas possible de créer des algorithmes d’apprentissage automatique qui soient toujours stables. L’article scientifique décrivant le résultat a été approuvé pour publication lors de l’une des principales conférences internationales sur l’informatique théorique, Foundations of Computer Science (FOCS).

« Je tiens à préciser que nous n’avons pas travaillé directement sur des applications de voitures automatisées. Cela semble néanmoins être un problème trop complexe pour que les algorithmes soient toujours stables », estime Amir Yehudayoff, ajoutant que cela n’implique pas nécessairement de conséquences majeures par rapport au développement des voitures automatisées :

« Si l’algorithme ne se trompe que dans quelques circonstances très rares, cela pourrait bien être acceptable. Mais si cela se produit dans un grand nombre de circonstances, ce sera une mauvaise nouvelle. »

L’article scientifique ne peut pas être appliqué par l’industrie pour identifier des bugs dans ses algorithmes. Ce n’était pas l’intention, explique le professeur :

« Nous développons un langage pour discuter des faiblesses des algorithmes de Machine Learning. Cela pourrait conduire à l’élaboration de lignes directrices décrivant la manière dont les algorithmes doivent être testés. Et à long terme, cela pourrait à nouveau conduire au développement d’algorithmes meilleurs et plus stables.

De l’intuition aux mathématiques

Une application possible pourrait consister à tester des algorithmes pour la protection de la vie privée numérique.

« Certaines entreprises pourraient prétendre avoir développé une solution absolument sécurisée pour la protection de la vie privée. Premièrement, notre méthodologie pourrait aider à établir que la solution ne peut pas être absolument sécurisée. Deuxièmement, il sera capable d’identifier les points faibles », estime Amir Yehudayoff.

Mais avant tout, l’article scientifique contribue à la théorie. Le contenu mathématique est particulièrement révolutionnaire, ajoute-t-il : « Nous comprenons intuitivement qu’un algorithme stable devrait fonctionner presque aussi bien qu’avant lorsqu’il est exposé à une petite quantité de bruit d’entrée. Tout comme le panneau routier avec un autocollant dessus. Mais en tant qu’informaticiens théoriques, nous avons besoin d’une définition ferme. Nous devons être capables de décrire le problème dans le langage mathématique. Quelle quantité exacte de bruit l’algorithme doit-il être capable de supporter, et à quel point la sortie doit-elle être proche de la sortie d’origine si nous devons accepter que l’algorithme soit stable ? C’est à cela que nous avons proposé une réponse.

Il est important de garder les limites à l’esprit

L’article scientifique a suscité un grand intérêt de la part de collègues du monde de l’informatique théorique, mais pas de la part de l’industrie technologique. Pas encore, du moins.

« Il faut toujours s’attendre à un certain délai entre un nouveau développement théorique et l’intérêt des personnes travaillant dans les applications », déclare Amir Yehudayoff tout en ajoutant en souriant : « Et certains développements théoriques resteront à jamais inaperçus. »

Cependant, il ne pense pas que cela se produise dans ce cas-ci : « Le Machine Learning continue de progresser rapidement et il est important de se rappeler que même les solutions qui fonctionnent très bien dans le monde réel ont encore des limites. Les machines peuvent parfois sembler capables de penser, mais après tout, elles ne possèdent pas l’intelligence humaine. C’est important de garder cela à l’esprit.