Les capacités avancées des systèmes d’IA, tels que ChatGPT, ont suscité des discussions sur leur potentiel de conscience. Cependant, les neuroscientifiques Jaan Aru, Matthew Larkum et Mac Shine affirment que ces systèmes sont probablement inconscients. Ils fondent leurs arguments sur le manque d’informations incorporées dans l’IA, l’absence de certains systèmes neuronaux liés à la conscience des mammifères et les chemins évolutifs disparates des organismes vivants et de l’IA. La complexité de la conscience des entités biologiques dépasse de loin celle des modèles d’IA actuels.

La sophistication croissante des systèmes d’intelligence artificielle (IA) a conduit certains à spéculer que ces systèmes pourraient bientôt posséder une conscience. Cependant, nous pourrions sous-estimer les mécanismes neurobiologiques qui sous-tendent la conscience humaine.

Les systèmes d’IA modernes sont capables de nombreux comportements étonnants. Par exemple, lorsque l’on utilise des systèmes comme ChatGPT, les réponses sont (parfois) assez humaines et intelligentes. Lorsque nous, les humains, interagissons avec ChatGPT, nous percevons consciemment le texte généré par le modèle de langage. Vous percevez actuellement consciemment ce texte ici !

La question est de savoir si le modèle linguistique perçoit également notre texte lorsque nous le lui incitons. Ou s’agit-il simplement d’un zombie fonctionnant sur la base d’algorithmes intelligents de correspondance de modèles ? Sur la base du texte qu’il génère, il est facile de croire que le système pourrait être conscient. Cependant, dans cette nouvelle recherche, Jaan Aru, Matthew Larkum et Mac Shine adoptent un angle neuroscientifique pour répondre à cette question.

Perspectives neuroscientifiques sur l’IA

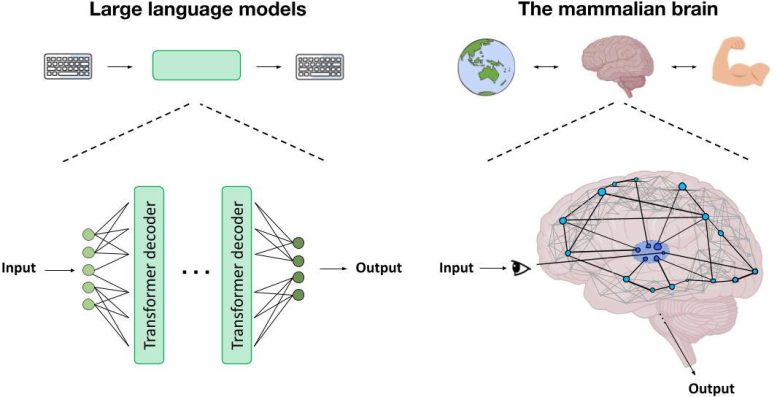

Tous trois étant neuroscientifiques, ces auteurs soutiennent que même si les réponses de systèmes comme ChatGPT semblent conscientes, elles ne le sont probablement pas. Premièrement, les entrées dans les modèles linguistiques manquent du contenu informationnel incarné et intégré caractéristique de notre contact sensoriel avec le monde qui nous entoure. Deuxièmement, les architectures des algorithmes d’IA actuels manquent de fonctionnalités clés du système thalamocortical qui ont été liées à la conscience chez les mammifères.

Enfin, les trajectoires évolutives et développementales qui ont conduit à l’émergence d’organismes vivants conscients n’ont sans doute aucun parallèle dans les systèmes artificiels tels qu’envisagés aujourd’hui. L’existence des organismes vivants dépend de leurs actions et leur survie est intimement liée à des processus cellulaires, intercellulaires et organisationnels à plusieurs niveaux aboutissant à l’action et à la conscience.

À gauche : un schéma illustrant l’architecture de base d’un grand modèle de langage, qui peut avoir

des dizaines, voire plus d’une centaine de blocs de décodeur disposés de manière anticipée.

À droite : une carte heuristique du système thalamocortical, qui génère des modèles d’activité complexes censés être à la base de la conscience. Crédit : Mac Shine, Jaan Aru

Ainsi, même s’il est tentant de supposer que ChatGPT et des systèmes similaires pourraient être conscients, cela sous-estimerait gravement la complexité des mécanismes neuronaux qui génèrent la conscience dans notre cerveau. Les chercheurs ne parviennent pas à un consensus sur la manière dont la conscience s’élève dans notre cerveau. Ce que nous savons, et ce que souligne ce nouvel article, c’est que les mécanismes sont probablement bien plus complexes que ceux qui sous-tendent les modèles linguistiques actuels.

Par exemple, comme le soulignent ces travaux, les vrais neurones ne s’apparentent pas aux neurones des réseaux neuronaux artificiels. Les neurones biologiques sont de véritables entités physiques, qui peuvent croître et changer de forme, alors que les neurones des grands modèles de langage ne sont que des morceaux de code dénués de sens. Nous avons encore un long chemin à parcourir pour comprendre la conscience et, par conséquent, un long chemin vers des machines conscientes.