PlatoNeRF, créé par le MIT et Meta, utilise le lidar multibounce et l'apprentissage automatique pour permettre aux véhicules autonomes de détecter les obstacles cachés. Cette technique innovante, qui aide également dans la réalité augmentée/réalité virtuelle et la robotique, utilise les ombres pour générer des reconstructions 3D précises des environnements.

Les chercheurs exploitent les ombres pour modéliser des scènes 3D, y compris des objets masqués à la vue.

Cette technique pourrait conduire à des véhicules autonomes plus sûrs, à des casques AR/VR plus efficaces ou à des robots d’entrepôt plus rapides.

Imaginez que vous traversez un tunnel dans un véhicule autonome, mais qu'un accident a bloqué la circulation devant vous sans que vous le sachiez. Normalement, vous devriez vous fier à la voiture qui vous précède pour savoir que vous devez commencer à freiner. Mais que se passerait-il si votre véhicule pouvait voir autour de la voiture qui vous précède et freiner encore plus tôt ?

Des chercheurs de MIT et Meta ont développé une technique de vision par ordinateur qui pourrait un jour permettre à un véhicule autonome de faire exactement cela.

Ils ont mis au point une méthode qui permet de créer des modèles 3D physiquement précis d'une scène entière, y compris des zones masquées, à partir d'images prises à partir d'une seule position de caméra. Leur technique utilise les ombres pour déterminer ce qui se trouve dans les parties masquées de la scène.

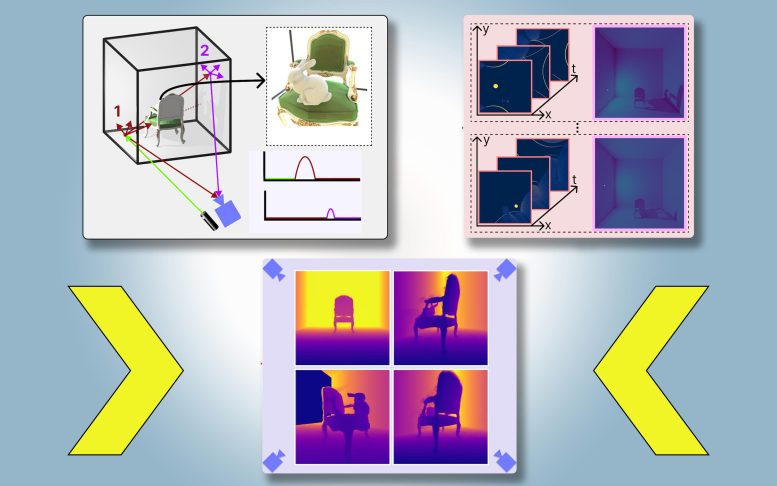

Plato-NeRF est un système de vision par ordinateur qui combine des mesures lidar avec l'apprentissage automatique pour reconstruire une scène 3D, y compris des objets cachés, à partir d'une seule vue de caméra en exploitant les ombres. Ici, le système modélise avec précision le lapin sur la chaise, même si ce lapin est caché de la vue. Crédit : Avec l'aimable autorisation des chercheurs, édité par MIT News

Ils appellent leur approche PlatoNeRF, basée sur l'allégorie de la caverne de Platon, un passage de la « République » du philosophe grec dans lequel des prisonniers enchaînés dans une grotte discernent la réalité du monde extérieur en fonction des ombres projetées sur la paroi de la grotte.

En combinant la technologie lidar (détection et télémétrie par la lumière) avec apprentissage automatiquePlatoNeRF peut générer des reconstructions de géométrie 3D plus précises que certaines techniques d'IA existantes. De plus, PlatoNeRF est plus efficace pour reconstruire en douceur des scènes où les ombres sont difficiles à voir, comme celles avec une forte lumière ambiante ou des arrière-plans sombres.

Améliorer la réalité augmentée/réalité virtuelle et la robotique avec PlatoNeRF

En plus d’améliorer la sécurité des véhicules autonomes, PlatoNeRF pourrait rendre les casques AR/VR plus efficaces en permettant à un utilisateur de modéliser la géométrie d’une pièce sans avoir à se déplacer pour prendre des mesures. Il pourrait également aider les robots d’entrepôt à trouver plus rapidement des articles dans des environnements encombrés.

« Notre idée principale était de prendre deux choses qui ont déjà été faites dans des disciplines différentes et de les réunir : le lidar multibounce et l’apprentissage automatique. Il s’avère que lorsque vous réunissez ces deux éléments, vous découvrez de nombreuses nouvelles opportunités à explorer et à tirer le meilleur parti des deux mondes », explique Tzofi Klinghoffer, étudiant diplômé en arts et sciences des médias du MIT, assistant de recherche au Camera Culture Group du MIT Media Lab et auteur principal d’un article sur PlatoNeRF.

Klinghoffer a rédigé l'article avec son conseiller, Ramesh Raskar, professeur associé d'arts et de sciences médiatiques et chef du Camera Culture Group au MIT ; l'auteur principal Rakesh Ranjan, directeur de recherche en IA chez Meta Reality Labs ; ainsi que Siddharth Somasundaram, assistant de recherche au Camera Culture Group, et Xiaoyu Xiang, Yuchen Fan et Christian Richardt chez Meta. La recherche sera présentée lors de la conférence sur la vision par ordinateur et la reconnaissance de formes.

Reconstruction 3D avancée avec Lidar et Machine Learning

Reconstruire une scène 3D complète à partir d'un seul point de vue de caméra est un problème complexe.

Certaines approches d'apprentissage automatique utilisent des modèles d'IA génératifs qui tentent de deviner ce qui se trouve dans les zones occultées, mais ces modèles peuvent halluciner des objets qui n'existent pas réellement. D'autres approches tentent de déduire les formes d'objets cachés en utilisant les ombres d'une image couleur, mais ces méthodes peuvent s'avérer difficiles à voir lorsque les ombres sont difficiles à voir.

Pour PlatoNeRF, les chercheurs du MIT se sont appuyés sur ces approches en utilisant une nouvelle modalité de détection appelée single-photon lidar. Les lidars cartographient une scène 3D en émettant des impulsions lumineuses et en mesurant le temps que met cette lumière à rebondir vers le capteur. Étant donné que les lidars à photon unique peuvent détecter des photons individuels, ils fournissent des données à plus haute résolution.

Les chercheurs utilisent un lidar à photon unique pour éclairer un point cible de la scène. Une partie de la lumière rebondit sur ce point et revient directement au capteur. Cependant, la majeure partie de la lumière se disperse et rebondit sur d'autres objets avant de revenir au capteur. PlatoNeRF s'appuie sur ces deuxièmes rebonds de lumière.

En calculant le temps nécessaire à la lumière pour rebondir deux fois puis revenir au capteur lidar, PlatoNeRF capture des informations supplémentaires sur la scène, notamment la profondeur. Le deuxième rebond de la lumière contient également des informations sur les ombres.

Le système suit les rayons de lumière secondaires (ceux qui rebondissent du point cible vers d'autres points de la scène) pour déterminer quels points se trouvent dans l'ombre (en raison d'une absence de lumière). En fonction de l'emplacement de ces ombres, PlatoNeRF peut déduire la géométrie des objets cachés.

Le lidar éclaire séquentiellement 16 points, capturant plusieurs images qui sont utilisées pour reconstruire l'intégralité de la scène 3D.

« Chaque fois que nous éclairons un point de la scène, nous créons de nouvelles ombres. Comme nous disposons de toutes ces différentes sources d’éclairage, nous avons beaucoup de rayons lumineux qui se projettent tout autour, ce qui nous permet de sculpter la région qui est occultée et qui se trouve au-delà de l’œil visible », explique Klinghoffer.

Combinaison de champs de rayonnement neuronal et de lidar multi-rebonds

La clé de PlatoNeRF est la combinaison du lidar multi-rebond avec un type spécial de modèle d'apprentissage automatique connu sous le nom de champ de rayonnement neuronal (NeRF). Un NeRF encode la géométrie d'une scène dans les pondérations d'un réseau neuronal, ce qui confère au modèle une forte capacité à interpoler, ou à estimer, de nouvelles vues d'une scène.

Cette capacité d'interpolation conduit également à des reconstructions de scènes très précises lorsqu'elle est combinée avec un lidar multi-rebonds, explique Klinghoffer.

« Le plus grand défi a été de trouver comment combiner ces deux éléments. Nous avons dû réfléchir à la physique du transport de la lumière avec le lidar multi-rebonds et à la façon de modéliser cela avec l'apprentissage automatique », explique-t-il.

Ils ont comparé PlatoNeRF à deux méthodes alternatives courantes, l’une qui utilise uniquement le lidar et l’autre qui utilise uniquement un NeRF avec une image couleur.

Ils ont constaté que leur méthode était plus performante que les deux techniques, en particulier lorsque le capteur lidar avait une résolution inférieure. Cela rendrait leur approche plus pratique à déployer dans le monde réel, où les capteurs à faible résolution sont courants dans les appareils commerciaux.

« Il y a environ 15 ans, notre groupe a inventé la première caméra capable de « voir » dans les coins, qui fonctionne en exploitant plusieurs rebonds de lumière, ou « échos de lumière ». Ces techniques utilisaient des lasers et des capteurs spéciaux, et utilisaient trois rebonds de lumière. Depuis lors, la technologie lidar est devenue plus courante, ce qui a conduit à nos recherches sur des caméras capables de voir à travers le brouillard. Cette nouvelle technologie n'utilise que deux rebonds de lumière, ce qui signifie que le rapport signal/bruit est très élevé et que la qualité de la reconstruction 3D est impressionnante », explique Raskar.

À l’avenir, les chercheurs souhaitent essayer de suivre plus de deux rebonds de lumière pour voir comment cela pourrait améliorer les reconstructions de scènes. En outre, ils souhaitent appliquer des techniques d’apprentissage plus approfondies et combiner PlatoNeRF avec des mesures d’images en couleur pour capturer des informations sur la texture.

« Alors que les images de caméra des ombres ont longtemps été étudiées comme moyen de reconstruction 3D, ce travail revisite le problème dans le contexte du lidar, démontrant des améliorations significatives dans la précision « Les algorithmes intelligents peuvent offrir des capacités extraordinaires lorsqu’ils sont combinés à des capteurs ordinaires, notamment les systèmes lidar que beaucoup d’entre nous portent désormais dans leur poche », explique David Lindell, professeur adjoint au département d’informatique de l’Université de Toronto, qui n’a pas participé à ces travaux.