Dans leur quête pour entraîner les robots à des tâches concrètes, les chercheurs ont créé « Holodeck », un système d’IA capable de générer des environnements 3D détaillés et personnalisables à la demande, inspiré de la technologie holodeck de Star Trek. Ce système utilise de grands modèles de langage pour interpréter les demandes des utilisateurs et générer une vaste gamme de scénarios d’intérieur, aidant les robots à apprendre à naviguer plus efficacement dans de nouveaux espaces. (Concept d’artiste.) Crédit : Issues.fr.com

Des chercheurs de l’Université de Pennsylvanie et d’AI2 ont développé « Holodeck », un système avancé capable de générer une large gamme d’environnements virtuels pour la formation des agents d’IA.

Dans Star Trek : La Nouvelle Génération, le capitaine Picard et l'équipage de l'USS Enterprise utilisent le holodeck, une salle vide capable de générer des environnements tridimensionnels, pour préparer les missions et se divertir. Cette technologie simule tout, des jungles luxuriantes au Londres de Sherlock Holmes. Ces environnements profondément immersifs et entièrement interactifs sont personnalisables à l'infini ; l'équipage demande simplement un paramètre spécifique à l'ordinateur, et il se matérialise dans le holodeck.

Aujourd’hui, les environnements virtuels interactifs sont également utilisés pour entraîner les robots avant leur déploiement dans le monde réel, dans le cadre d’un processus appelé « Sim2Real ». Cependant, les environnements virtuels interactifs sont étonnamment rares. « Les artistes créent ces environnements manuellement », explique Yue Yang, doctorante dans les laboratoires de Mark Yatskar et Chris Callison-Burch, respectivement professeurs adjoint et associé en informatique et sciences de l’information (CIS). « Ces artistes pourraient passer une semaine à créer un seul environnement », ajoute Yang, en soulignant toutes les décisions impliquées, de l’agencement de l’espace au placement des objets en passant par les couleurs utilisées pour le rendu.

Défis liés à la création d'environnements de formation virtuels

Cette pénurie d’environnements virtuels constitue un problème si l’on veut entraîner des robots à naviguer dans le monde réel avec toute sa complexité. Les réseaux neuronaux, les systèmes qui alimentent la révolution de l’IA actuelle, nécessitent des quantités massives de données, ce qui signifie dans ce cas des simulations du monde physique. « Les systèmes d’IA générative comme ChatGPT sont entraînés sur des milliards de mots, et les générateurs d’images comme Midjourney et DALLE sur des milliards d’images », explique Callison-Burch. « Nous ne disposons que d’une fraction de cette quantité d’environnements 3D pour entraîner ce que l’on appelle l’« IA incarnée ». Si nous voulons utiliser des techniques d’IA générative pour développer des robots capables de naviguer en toute sécurité dans des environnements réels, nous devrons créer des millions, voire des milliards d’environnements simulés. »

En utilisant un langage courant, les utilisateurs peuvent demander à Holodeck de générer une variété pratiquement infinie d'espaces 3D, ce qui ouvre de nouvelles possibilités pour entraîner les robots à naviguer dans le monde. Crédit : Yue Yang

Entrez Holodeck, un système de génération d'environnements 3D interactifs co-créé par Callison-Burch, Yatskar, Yang et Lingjie Liu, professeur adjoint Aravind K. Joshi au CIS, avec des collaborateurs de Stanford, Université de Washingtonet l'Allen Institute for Artificial Intelligence (AI2). Nommé d'après son ancêtre de Star Trek, Holodeck génère une gamme pratiquement illimitée d'environnements intérieurs, en utilisant l'IA pour interpréter les demandes des utilisateurs. « Nous pouvons utiliser le langage pour le contrôler », explique Yang. « Vous pouvez facilement décrire les environnements que vous souhaitez et former les agents IA incarnés. »

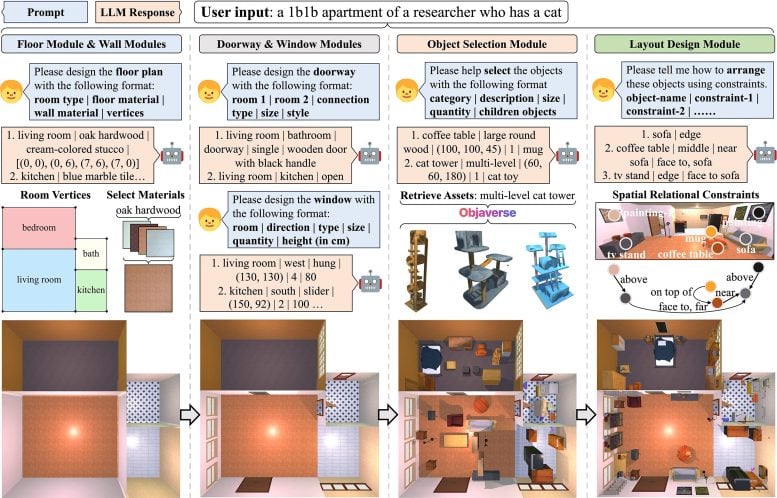

Holodeck exploite les connaissances intégrées dans les grands modèles de langage (LLM), les systèmes sous-jacents à ChatGPT et d’autres chatbots. « Le langage est une représentation très concise du monde entier », explique Yang. En effet, les LLM se révèlent avoir un niveau de connaissances étonnamment élevé sur la conception des espaces, grâce aux vastes quantités de texte qu’ils ingèrent pendant leur formation. En substance, Holodeck fonctionne en engageant un LLM dans une conversation, en utilisant une série soigneusement structurée de requêtes cachées pour décomposer les demandes des utilisateurs en paramètres spécifiques.

Application et test du Holodeck dans le monde réel

Tout comme le capitaine Picard pourrait demander à Holodeck de Star Trek de simuler un bar clandestin, les chercheurs peuvent demander à Holodeck de Penn de créer « l’appartement 1b1b d’un chercheur qui a un chat ». Le système exécute cette requête en la divisant en plusieurs étapes : d’abord, le sol et les murs sont créés, puis la porte et les fenêtres. Ensuite, Holodeck recherche dans Objaverse, une vaste bibliothèque d’objets numériques préfabriqués, le type de mobilier que l’on pourrait attendre d’un tel espace : une table basse, une tour à chat, etc. Enfin, Holodeck interroge un module d’agencement, que les chercheurs ont conçu pour contraindre le placement des objets, afin que vous ne vous retrouviez pas avec des toilettes s’étendant horizontalement à partir du mur.

Essentiellement, Holodeck engage un grand modèle de langage (LLM) dans une conversation, construisant un environnement virtuel pièce par pièce. Crédit : Yue Yang

Pour évaluer les capacités de Holodeck, en termes de réalisme et précisionLes chercheurs ont généré 120 scènes en utilisant Holodeck et ProcTHOR, un outil antérieur créé par AI2, et ont demandé à plusieurs centaines d'étudiants de Penn Engineering d'indiquer leur version préférée, sans savoir quelles scènes avaient été créées par quels outils. Pour chaque critère (sélection des ressources, cohérence de la mise en page et préférence globale), les étudiants ont systématiquement évalué plus favorablement les environnements générés par Holodeck.

Les chercheurs ont également testé la capacité d'Holodeck à générer des scènes moins courantes dans la recherche en robotique et plus difficiles à créer manuellement que des intérieurs d'appartements, comme des magasins, des espaces publics et des bureaux. En comparant les résultats d'Holodeck à ceux de ProcTHOR, qui ont été générés à l'aide de règles créées par des humains plutôt que de texte généré par l'IA, les chercheurs ont constaté une fois de plus que les évaluateurs humains préféraient les scènes créées par Holodeck. Cette préférence s'est maintenue dans un large éventail d'environnements intérieurs, des laboratoires scientifiques aux studios d'art, des vestiaires aux caves à vin.

Enfin, les chercheurs ont utilisé des scènes générées par Holodeck pour « peaufiner » un agent IA incarné. « Le test ultime d’Holodeck », explique Yatskar, « consiste à l’utiliser pour aider les robots à interagir avec leur environnement de manière plus sûre en les préparant à habiter des endroits où ils n’ont jamais été auparavant. »

Dans plusieurs types d'espaces virtuels, notamment les bureaux, les garderies, les gymnases et les salles de jeux, Holodeck a eu un effet prononcé et positif sur la capacité de l'agent à naviguer dans de nouveaux espaces.

Par exemple, alors que l'agent a réussi à trouver un piano dans une salle de musique seulement 6 % du temps lorsqu'il était pré-entraîné à l'aide de ProcTHOR (ce qui impliquait que l'agent effectue environ 400 millions de pas virtuels), l'agent a réussi plus de 30 % du temps lorsqu'il a été affiné à l'aide de 100 salles de musique générées par Holodeck.

« Ce domaine est resté longtemps cantonné à la recherche dans les espaces résidentiels », explique Yang. « Mais il existe tellement d’environnements différents – générer efficacement de nombreux environnements pour entraîner des robots a toujours été un grand défi, mais Holodeck offre cette fonctionnalité. »

Les chercheurs ont présenté Holodeck à la Conférence 2024 de l'Institut des ingénieurs électriciens et électroniciens (IEEE) et de la Computer Vision Foundation (CVF) sur la vision par ordinateur et la reconnaissance de formes (CVPR) à Seattle, Washington.

Cette étude a été menée à la Université de Pennsylvanie École d'ingénierie et de sciences appliquées et à l'Institut Allen pour l'intelligence artificielle (AI2).