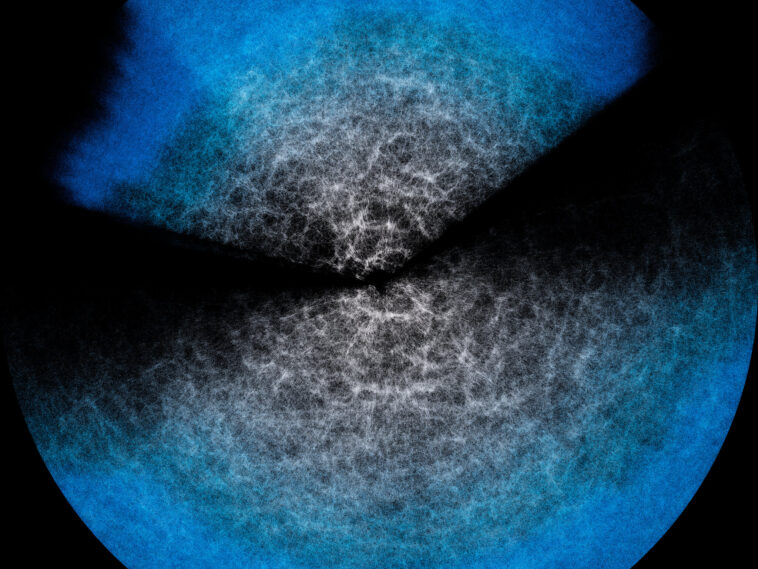

Si vous pensez qu'une galaxie est grande, comparez-la à la taille de l'univers: c'est juste un petit point qui, avec un grand nombre d'autres points minuscules, forme des grappes qui s'agrégèrent en superclusters, qui à leur tour tissent en filaments filetés de vides – un squelette 3D immense de notre univers.

Si cela vous donne un vertige et que vous vous demandez comment on peut comprendre ou même « voir » quelque chose de si vaste, la réponse est: ce n'est pas facile. Les scientifiques combinent la physique de l'univers avec des données d'instruments astronomiques et construisent des modèles théoriques, tels que les EFTOFLS (théorie efficace des champs de la structure à grande échelle). Nés par des observations, ces modèles décrivent statistiquement le « Web cosmique » et permettent à ses paramètres clés d'être estimés.

Des modèles comme EFTOFLSS, cependant, exigent beaucoup de temps et de ressources informatiques. Étant donné que les ensembles de données astronomiques à notre disposition augmentent de façon exponentielle, nous avons besoin de moyens d'éclaircir l'analyse sans perdre de précision. C'est pourquoi les émulateurs existent: ils « imitent » comment les modèles réagissent, mais fonctionnent beaucoup plus rapidement.

Puisqu'il s'agit d'une sorte de «raccourci», quel est le risque de perdre la précision?

Une équipe internationale comprenant, entre autres, INAF (Italie), l'Université de Parme (Italie) et l'Université de Waterloo (Canada) Journal of Cosmology and Astroparticle Physics une étude testant l'effort de l'émulateur.jl, qu'ils ont conçu. L'étude est intitulée « Effort.jl: un émulateur rapide et différenciable pour la théorie du champ efficace de la structure à grande échelle de l'univers. »

Cela montre que Effort.jl offre essentiellement la même correction que le modèle qu'il imite – parfois encore plus fin, tout en fonctionnant en minutes sur un ordinateur portable standard au lieu d'un supercalculateur.

« Imaginez vouloir étudier le contenu d'un verre d'eau au niveau de ses composants microscopiques, des atomes individuels, ou même plus petits: en théorie, vous pouvez. Mais si nous voulions décrire en détail ce qui se passe lorsque l'eau bouge, la croissance explosive des calculs requis rend pratiquement impossible l'étude.

« Cependant, vous pouvez coder certaines propriétés au niveau microscopique et voir leur effet au niveau macroscopique, à savoir le mouvement du liquide dans le verre. C'est ce que fait une théorie de champ efficace, c'est-à-dire un modèle comme EftofLSS, où l'eau dans mon exemple est l'univers à très grande échelle et les composants microscopiques sont de petits processus physiques. »

Le modèle théorique explique statistiquement la structure qui donne naissance aux données collectées: les observations astronomiques sont transmises au code, qui calcule une «prédiction». Mais cela nécessite du temps et un calcul substantiel. Étant donné le volume de données d'aujourd'hui – et ce que l'on attend des enquêtes qui commencent ou venaient bientôt (comme Desi, qui a déjà publié son premier lot de données, et Euclid) – il n'est pas pratique de le faire de manière exhaustive à chaque fois.

« C'est pourquoi nous nous tournons maintenant vers des émulateurs comme le nôtre, ce qui peut considérablement réduire le temps et les ressources », poursuit Bonici.

Un émulateur imite essentiellement ce que fait le modèle: son noyau est un réseau neuronal qui apprend à associer les paramètres d'entrée aux prédictions déjà composées du modèle.

Le réseau est formé sur les sorties du modèle et, après l'entraînement, peut se généraliser aux combinaisons de paramètres qu'il n'a pas vus. L'émulateur ne « comprend » pas « la physique elle-même: il connaît très bien les réponses du modèle théorique et peut anticiper ce qu'il publierait pour une nouvelle entrée.

Effort.jl L'originalité est qu'il réduit encore la phase de formation en se construisant dans les connaissances de l'algorithme que nous avons déjà sur la façon dont les prédictions changent lorsque les paramètres changent: au lieu de faire en sorte que le réseau « réapprend » ceux-ci, il les utilise depuis le début.

Effort.jl utilise également des gradients – IE, « combien et dans quelle direction » Les prédictions changent si vous modifiez un paramètre par une petite quantité – un autre élément qui aide l'émulateur à apprendre de beaucoup moins d'exemples, à couper les besoins de calcul et à lui permettre de fonctionner sur des machines plus petites.

Un outil comme celui-ci nécessite une validation approfondie: si l'émulateur ne connaît pas la physique, à quel point sommes-nous sûrs que son raccourci donne des réponses correctes (c'est-à-dire les mêmes que le modèle donnerait)? L'étude récemment publiée répond exactement à cela, montrant que la précision de l'effort.jl – à la fois simulées et réelles – est en accord étroit avec le modèle.

« Et dans certains cas, où avec le modèle, vous devez couper une partie de l'analyse pour accélérer les choses, avec Effort.JL, nous avons également pu inclure ces pièces manquantes », conclut Bonici.

Effort.jl apparaît donc comme un allié précieux pour analyser les versions de données à venir à partir d'expériences comme Desi et Euclid, qui promettent d'approfondir considérablement notre connaissance de l'univers à grande échelle.