Une étude prédit que les acteurs malveillants utiliseront quotidiennement l’IA d’ici mi-2024 pour diffuser des contenus toxiques dans les communautés en ligne grand public, ce qui pourrait avoir un impact sur les élections. Crédit : Issues.fr.com

Une étude prévoit que d’ici mi-2024, les mauvais acteurs devraient utiliser de plus en plus l’IA dans leurs activités quotidiennes. La recherche, menée par Neil F. Johnson et son équipe, implique une exploration des communautés en ligne associées à la haine. Leur méthodologie comprend la recherche de la terminologie répertoriée dans la base de données des symboles de haine de l’Anti-Defamation League, ainsi que l’identification des groupes signalés par le Southern Poverty Law Center.

À partir d’une première liste de communautés de « mauvais acteurs » trouvées utilisant ces termes, les auteurs évaluent les communautés liées par les communautés de mauvais acteurs. Les auteurs répètent cette procédure pour générer une carte du réseau des communautés de mauvais acteurs et des groupes en ligne les plus traditionnels auxquels ils se connectent.

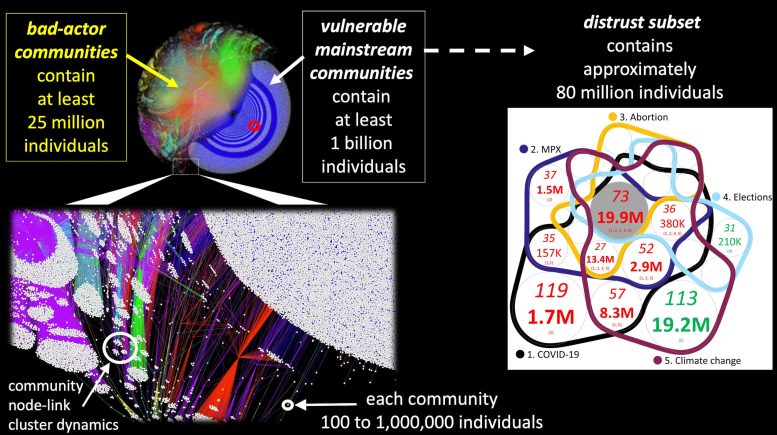

Communautés traditionnelles classées dans la catégorie « sous-ensemble de méfiance »

Certaines communautés dominantes sont classées comme appartenant à un « sous-ensemble de méfiance » si elles organisent des discussions significatives sur COVID 19, MPX, avortement, élections ou changement climatique. En utilisant la carte résultante du « champ de bataille » actuel des mauvais acteurs en ligne, qui comprend plus d’un milliard d’individus, les auteurs projettent comment l’IA peut être utilisée par ces mauvais acteurs.

L’écosystème grand public mauvais acteur-vulnérable (panneau de gauche). Il comprend des communautés de mauvais acteurs interconnectées (nœuds colorés) et des communautés dominantes vulnérables (nœuds blancs, qui sont des communautés avec lesquelles les communautés de mauvais acteurs ont formé un lien direct). Ce réseau empirique est représenté à l’aide de l’algorithme de mise en page ForceAtlas2, qui est spontané, donc des ensembles de communautés (nœuds) apparaissent plus proches lorsqu’ils partagent plus de liens. Différentes couleurs correspondent à différentes plateformes. Un petit anneau rouge montre la communauté YouTube du tireur texan de 2023 à titre d’illustration. Le panneau de droite montre le diagramme de Venn des sujets abordés dans le sous-ensemble de méfiance. Chaque cercle désigne une catégorie de communautés qui discutent d’un ensemble spécifique de sujets, répertoriés en bas. Le nombre de taille moyenne correspond au nombre de communautés discutant de cet ensemble spécifique de sujets, et le nombre le plus élevé correspond au nombre d’individus correspondant. Par exemple, le cercle gris indique que 19,9 millions d’individus (73 communautés) discutent des 5 sujets. Le chiffre est rouge si une majorité est anti-vaccination ; vert si la majorité est neutre sur les vaccins. Seules les régions comptant > 3 % du total des communautés sont étiquetées. Les anti-vaccinations dominent. Dans l’ensemble, ce chiffre montre à quel point l’IA des mauvais acteurs pourrait rapidement atteindre une portée mondiale et pourrait également se développer rapidement en attirant des communautés déjà méfiantes. Crédit : Johnson et coll.

Les auteurs prédisent que les mauvais acteurs utiliseront de plus en plus l’IA pour diffuser continuellement des contenus toxiques sur les communautés grand public en utilisant les premières itérations d’outils d’IA, car ces programmes ont moins de filtres conçus pour empêcher leur utilisation par de mauvais acteurs et sont des programmes disponibles gratuitement suffisamment petits pour tenir sur un ordinateur. ordinateur portable.

Attaques basées sur l’IA presque quotidiennes d’ici mi-2024

Les auteurs prédisent que de telles attaques d’IA malveillantes se produiront presque quotidiennement d’ici la mi-2024, à temps pour affecter les élections aux États-Unis et dans d’autres pays. Les auteurs soulignent que l’IA étant encore nouvelle, leurs prédictions sont nécessairement spéculatives, mais espèrent que leurs travaux serviront néanmoins de point de départ à des discussions politiques sur la gestion des menaces des mauvais acteurs de l’IA.