Dans certains des cas les plus difficiles de la médecine, le plus difficile n’est pas de choisir le bon diagnostic. C'est y penser du tout. L’intelligence artificielle pourrait désormais être meilleure que les médecins dans ce domaine, suggère une nouvelle étude.

« Nous assistons à un changement technologique très profond qui va remodeler la médecine », a déclaré Arjun Manrai, scientifique en données biomédicales à l'Université Harvard, lors d'une conférence de presse le 28 avril.

Ce changement est motivé par les progrès des grands modèles de langage, la même technologie sur laquelle ChatGPT d'OpenAI est construit. Les nouvelles versions, appelées modèles de raisonnement, peuvent résoudre des problèmes complexes étape par étape. En 2025, 1 médecin et infirmier sur 5 dans le monde utilisait l’IA pour obtenir un deuxième avis sur des cas complexes, et plus de la moitié souhaite l’utiliser à cette fin, selon une enquête menée auprès de plus de 2 000 cliniciens. Mais l’efficacité de la technologie dans un contexte médical a fait l’objet de débats.

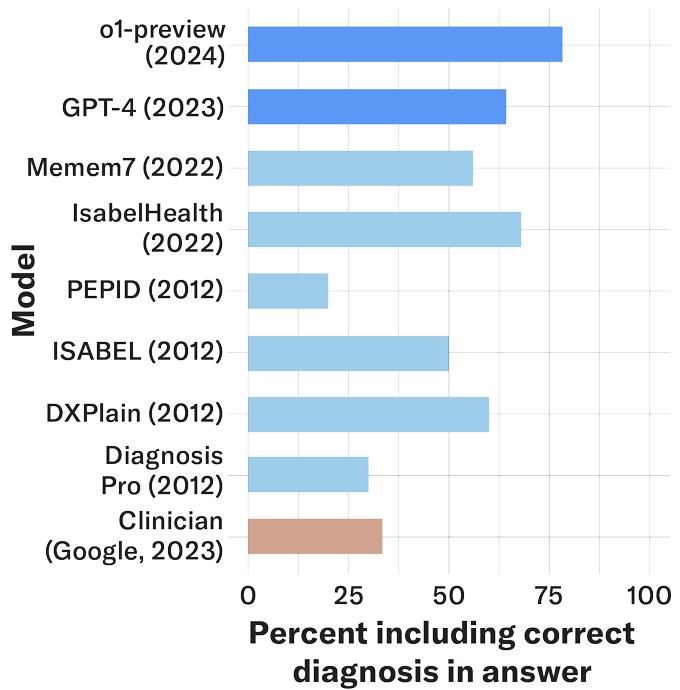

Manrai et ses collègues ont testé le modèle de prévisualisation o-1 d'OpenAI sur une gamme de cas médicaux, y compris des ensembles classiques de symptômes utilisés dans la formation médicale ainsi que des données réelles provenant directement des dossiers de 76 patients ayant visité une salle d'urgence à Boston. Lors de ces tests de raisonnement clinique, le modèle d'IA était plus susceptible que les médecins d'inclure le diagnostic correct, ou quelque chose de très proche, parmi ses réponses possibles, rapportent les chercheurs le 30 avril dans Science.

Tous les chercheurs ne sont pas convaincus que cela signifie que nous devrions faire confiance à l’IA pour nos diagnostics, arguant que le raisonnement de l’IA est encore loin de ce que les médecins humains peuvent faire. « Quand on parle de raisonnement clinique, cela ne veut pas dire la même chose que de raisonnement moral », explique Arya Rao, chercheuse à la Harvard Medical School, qui n'a pas participé à l'étude. « Ces modèles ont été optimisés pour effectuer ce genre de pensée séquentielle que nous appelons raisonnement, mais ce n'est pas du tout la même chose que la façon dont nous apprenons à raisonner aux étudiants en médecine. »

Manrai n’est pas opposé à cette critique, soulignant que la technologie de l’IA devrait aider plutôt que remplacer les personnes occupant des postes médicaux. « En fin de compte, je pense que les humains veulent qu’ils les guident… à travers des décisions de traitement difficiles », a-t-il déclaré.

Pourtant, les résultats montrent que ce type d’IA « fonctionne pour établir des diagnostics dans le monde réel », a déclaré le co-auteur Adam Rodman, médecin au Beth Israel Deaconess Medical Center de Boston, lors de la conférence de presse.

Il a décrit un patient qui s'était présenté aux urgences avec ce qui semblait être des symptômes respiratoires courants, qui avait récemment subi une greffe d'organe et qui était immunodéprimé. Le patient s’est avéré souffrir d’une dangereuse infection carnivore nécessitant une intervention chirurgicale. « Le modèle s'en méfiait en fait [infection] dès le début, probablement 12 à 24 heures avant que le médecin humain ne se méfie de cela », a déclaré Rodman.

Rao félicite l'équipe pour sa présentation [AI] « en tant que prolongement du médecin, et non en remplacement ». Elle qualifie l’étude de « rigoureuse et réfléchie ». Cependant, elle ne pense pas qu’il existe suffisamment de preuves pour affirmer que les modèles d’IA ont dépassé le raisonnement clinique.

Son équipe a publié le 13 avril une étude qui a testé 21 modèles d’IA à chaque étape du processus menant à un diagnostic. Les modèles de raisonnement ont globalement obtenu les scores les plus élevés. Mais lorsque l'équipe de Rao a exploré pour identifier les parties du processus de diagnostic les plus délicates pour l'IA, les chercheurs ont découvert un point faible qui persistait des modèles les plus anciens aux plus récents. C’est le processus consistant à considérer plusieurs diagnostics incertains différents.

Les modèles d’IA basés sur les LLM ont tendance à tirer des conclusions hâtives. « Leur raisonnement est fragile, précisément là où l’incertitude et les nuances comptent le plus », écrivent Rao et son équipe dans leur article. Leur conclusion était que les LLM ne sont pas encore prêts à prendre des décisions en milieu médical.

Ces deux études ont évalué différents modèles d’IA de différentes manières. Pourtant, les résultats ne sont pas aussi opposés qu’il y paraît à première vue, affirment les deux équipes. Ils conviennent que la prochaine étape devrait être davantage de recherche.

L'équipe de Manrai prévoit des essais cliniques pour aider à répondre à la question : « Comment pouvons-nous intégrer de manière sûre et réfléchie [AI] en soins ? Rao aime cette approche. Beaucoup de gens « n'ont pas suffisamment accès aux soins », dit-elle. Un jour, note-t-elle, « je pense que l’IA peut être un excellent égaliseur. »