L'IA est depuis longtemps coupable d'erreurs systématiques qui discriminent certains groupes démographiques. La reconnaissance faciale était autrefois l'un des pires contrevenants.

Pour les hommes blancs, c'était extrêmement précis. Pour d'autres, les taux d'erreur peuvent être 100 fois plus élevés. Ce biais a des conséquences réelles – allant de la fermeture d'un téléphone portable à des arrestations injustifiées en fonction des matchs de reconnaissance faciale défectueux.

Au cours des dernières années, cet écart de précision s'est considérablement réduit. «À bout portant, les systèmes de reconnaissance faciale sont presque assez parfaits», explique Xiaoming Liu, informaticien de la Michigan State University à East Lansing. Les meilleurs algorithmes peuvent désormais atteindre une précision de près de 99,9% entre les tons de peau, les âges et les sexes.

Mais une grande précision a un coût élevé: la confidentialité individuelle. Les sociétés et les institutions de recherche ont balayé les visages de millions de personnes d'Internet pour former des modèles de reconnaissance faciale, souvent sans leur consentement. Non seulement les données sont volées, mais cette pratique ouvre également des portes pour le vol d'identité ou le dépassement de la surveillance.

Pour résoudre les problèmes de confidentialité, une proposition surprenante prend de l'ampleur: utiliser des visages synthétiques pour former les algorithmes.

Ces images générées par ordinateur semblent réelles mais n'appartiennent à aucune personne réelle. L'approche en est à ses débuts; Les modèles formés sur ces «Forts de profondeur» sont encore moins précis que ceux formés sur les visages du monde réel. Mais certains chercheurs sont optimistes que les outils d'IA génératifs s'améliorent, les données synthétiques protégeront les données personnelles tout en maintenant l'équité et la précision dans tous les groupes.

«Chaque personne, quelle que soit sa couleur de peau ou son sexe ou son âge, devrait avoir une chance égale d'être correctement reconnue», explique Ketan Kotwal, informaticien de l'IDIAP Research Institute de Martigny, en Suisse.

Comment l'intelligence artificielle identifie les visages

La reconnaissance faciale avancée est devenue possible pour la première fois dans les années 2010, grâce à un nouveau type d'architecture d'apprentissage en profondeur appelé un réseau neuronal convolutionnel. CNNS traite les images à travers de nombreuses couches séquentielles d'opérations mathématiques. Les premières couches répondent à des modèles simples tels que les bords et les courbes. Les couches ultérieures combinent ces sorties en caractéristiques plus complexes, telles que les formes des yeux, du nez et des bouches.

Dans les systèmes de reconnaissance faciale modernes, un visage est d'abord détecté sur une image, puis tourné, centré et redimensionné à une position standard. Le CNN glisse ensuite sur le visage, choisit ses modèles distinctifs et les condense en un vecteur – une collection de nombres en forme de liste – appelée modèle. Ce modèle peut contenir des centaines de nombres et «est essentiellement votre numéro de sécurité sociale», dit Liu.

Pour faire tout cela, le CNN est d'abord formé sur des millions de photos montrant les mêmes individus dans des conditions variables – un éclairage, des angles, une distance ou des accessoires différents – et étiqueté avec leur identité. Parce que le CNN est informé exactement qui apparaît sur chaque photo, il apprend à positionner des modèles de la même personne proches les uns des autres dans son «espace» mathématique et à pousser ceux de différentes personnes.

Cette représentation constitue la base des deux principaux types d'algorithmes de reconnaissance faciale. Il y a «un à un»: êtes-vous qui vous dites que vous êtes? Le système vérifie votre visage sur une photo stockée, comme lors du déverrouillage d'un smartphone ou de la commande du passeport. L'autre est «un-à-plusieurs»: qui êtes-vous? Le système recherche votre visage dans une grande base de données pour trouver une correspondance.

Mais il n'a pas fallu longtemps aux chercheurs pour réaliser que ces algorithmes ne fonctionnent pas aussi bien pour tout le monde.

Pourquoi l'équité dans la reconnaissance faciale a été insaisissable

Une étude de 2018 a été la première à abandonner la bombe: dans les algorithmes de classification faciale commerciale, plus la peau d'une personne est foncée, plus les erreurs se produisent. Même les femmes noires célèbres ont été classées comme des hommes, dont Michelle Obama par Microsoft et Oprah Winfrey par Amazon.

La classification faciale est un peu différente de la reconnaissance faciale. La classification signifie attribuer un visage à une catégorie, comme les hommes ou les femmes, plutôt que de confirmer l'identité. Mais les experts ont noté que le défi de base de la classification et de la reconnaissance est le même. Dans les deux cas, l'algorithme doit extraire et interpréter les caractéristiques faciales. Des échecs plus fréquents pour certains groupes suggèrent un biais algorithmique.

En 2019, l'Institut national des sciences et de la technologie a offert une confirmation supplémentaire. Après avoir évalué près de 200 algorithmes commerciaux, NIST a constaté que les algorithmes correspondants individuels n'avaient qu'un dixième à un centième de la précision dans l'identification des visages asiatiques et noirs par rapport aux visages blancs, et plusieurs algorithmes un à plusieurs produisaient plus de faux positifs pour les femmes noires.

Les erreurs que ces tests soulignent peuvent avoir des conséquences sérieuses et réelles. Il y a eu au moins huit cas d'arrestations injustifiées en raison de la reconnaissance faciale. Sept d'entre eux étaient des hommes noirs.

Le biais dans les modèles de reconnaissance faciale est «intrinsèquement un problème de données», explique Anubhav Jain, informaticien de l'Université de New York. Les ensembles de données de formation précoce contenaient souvent beaucoup plus d'hommes blancs que d'autres groupes démographiques. En conséquence, les modèles sont devenus meilleurs pour distinguer les visages blancs et mâles par rapport aux autres.

Aujourd'hui, équilibrer les ensembles de données, les progrès de la puissance de calcul et des fonctions de perte plus intelligente – une étape de formation qui aide les algorithmes à mieux apprendre – ont aidé à pousser la reconnaissance faciale à proximité. Le NIST continue de comparer les systèmes par le biais de tests mensuels, où des centaines d'entreprises soumettent volontairement leurs algorithmes, y compris ceux utilisés dans des endroits comme les aéroports. Depuis 2018, les taux d'erreur ont chuté de plus de 90%, et presque tous les algorithmes ont une précision de plus de 99% dans des paramètres contrôlés.

À son tour, le biais démographique n'est plus un problème algorithmique fondamental, dit Liu. « Lorsque les performances globales atteignent 99,9%, il n'y a presque aucune différence entre différents groupes, car chaque groupe démographique peut très bien être classé. »

Bien que cela semble être une bonne chose, il y a une prise.

Les faux visages pourraient-ils résoudre des problèmes de confidentialité?

Après l'étude de 2018 sur les algorithmes qui confond des femmes à la peau sombre avec des hommes, IBM a publié un ensemble de données appelé Diversity in Faces. L'ensemble de données était rempli de plus d'un million d'images annotées avec la race des gens, le sexe et d'autres attributs. C'était une tentative de créer le type d'ensemble de données de formation large et équilibré que ses algorithmes ont été critiqués pour manquer.

Mais les images ont été grattées du site Web de partage de photos Flickr sans demander aux propriétaires d'images, déclenchant une énorme réaction. Et IBM est loin d'être seul. On estime qu'un autre grand fournisseur utilisé par les forces de l'ordre, Clearview AI, aurait rassemblé plus de 60 milliards d'images à partir d'endroits comme Instagram et Facebook sans consentement.

Ces pratiques ont déclenché un autre ensemble de débats sur la façon de collecter éthiquement des données pour la reconnaissance faciale. Les bases de données biométriques présentent d'énormes risques de confidentialité, dit Jain. «Ces images peuvent être utilisées frauduleusement ou malicieusement», comme pour le vol d'identité ou la surveillance.

Une correction potentielle? De faux visages. En utilisant la même technologie derrière DeepFakes, un nombre croissant de chercheurs pensent qu'ils peuvent créer le type et la quantité de fausses identités nécessaires pour former des modèles. En supposant que l'algorithme ne crache pas accidentellement un vrai visage, «il n'y a aucun problème avec la vie privée», explique Pavel Korshunov, un informaticien également à l'IDIAP Research Institute.

La création des ensembles de données synthétiques nécessite deux étapes. Tout d'abord, générez un faux visage unique. Ensuite, faites des variations de ce visage sous différents angles, éclairage ou avec des accessoires. Bien que les générateurs qui le font doivent encore être formés sur des milliers d'images réelles, ils nécessitent beaucoup moins que les millions nécessaires pour former directement un modèle de reconnaissance.

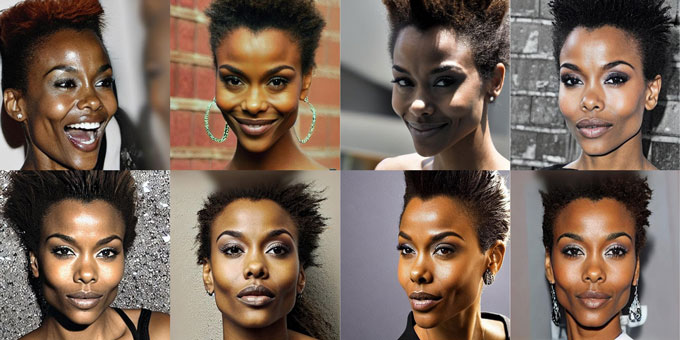

Maintenant, le défi est de former des modèles avec des données synthétiques pour être très précis pour tout le monde. Une étude soumise le 28 juillet à Arxiv.org rapporte que les modèles formés avec des ensembles de données synthétiques équilibrés démographiquement étaient meilleurs pour réduire le biais entre les groupes raciaux que les modèles formés sur des ensembles de données réels de la même taille.

Dans l'étude, Korshunov, Kotwal et ses collègues ont utilisé deux modèles de texte à l'image pour générer chacun environ 10 000 visages synthétiques avec une représentation démographique équilibrée. Ils ont également sélectionné au hasard 10 000 faces réelles à partir d'un ensemble de données appelé webface. Les modèles de reconnaissance faciale ont été formés individuellement sur les trois sets.

Lorsqu'il a été testé sur les visages africains, asiatiques, caucasiens et indiens, le modèle formé par le fainé a atteint une précision moyenne de 85% mais a montré un biais: il était précis à 90% pour les visages caucasiens et seulement 81% pour les visages africains. Cette disparité découle probablement de la surreprésentation par WebFace des visages caucasiens, dit Korshunov, un problème d'échantillonnage qui afflige souvent les ensembles de données du monde réel qui n'essaient pas délibérément d'être équilibrés.

Bien que l'un des modèles formés sur les faces synthétiques ait une précision moyenne inférieure de 75%, il n'avait que un tiers de la variabilité du modèle WebFace entre les quatre groupes démographiques. Cela signifie que même si la précision globale a chuté, les performances du modèle étaient beaucoup plus cohérentes, quelle que soit la race.

Cette baisse de précision est actuellement le plus grand obstacle pour utiliser des données synthétiques pour former des algorithmes de reconnaissance faciale. Cela se résume à deux raisons principales. Le premier est une limite du nombre d'identités uniques qu'un générateur peut produire. La seconde est que la plupart des générateurs ont tendance à générer de jolies images de type studio qui ne reflètent pas la variété désordonnée d'images du monde réel, telles que des visages obscurcis par les ombres.

Pour pousser la précision plus élevée, les chercheurs prévoient d'explorer une approche hybride ensuite: en utilisant des données synthétiques pour enseigner à un modèle les caractéristiques du visage et les variations communes à différents groupes démographiques, puis affinage ce modèle avec des données réelles obtenues avec consentement.

Le domaine progresse rapidement – les premières propositions à utiliser des données synthétiques pour la formation de modèles de reconnaissance faciale n'ont émergé qu'en 2023. Pourtant, étant donné les améliorations rapides des générateurs d'images depuis lors, Korshunov dit qu'il est impatient de voir à quel point les données synthétiques peuvent aller.

Mais la précision de la reconnaissance faciale peut être une épée à double tranchant. S'il est inexact, l'algorithme lui-même fait du mal. S'il est précis, l'erreur humaine peut toujours provenir de la dépendance sur le système. Et les défenseurs des droits civils avertissent que les technologies de reconnaissance faciale trop précises pourraient nous suivre indéfiniment dans le temps et l'espace.

Les chercheurs universitaires reconnaissent cet équilibre délicat, mais voyez le résultat différemment. «Si vous utilisez un système moins précis, vous êtes susceptible de suivre les mauvaises personnes», explique Kotwal. « Donc, si vous voulez avoir un système, ayons un système correct et très précis. »