Ces dernières années, avec la disponibilité publique des outils d'IA, de plus en plus de personnes ont pris conscience de la façon dont le fonctionnement interne de l'intelligence artificielle peut ressembler à ceux d'un cerveau humain.

Il existe plusieurs similitudes dans le fonctionnement des machines et des cerveaux humains; Par exemple, dans la façon dont ils représentent le monde sous forme abstrait, généralisent à partir de données limitées et de données de processus en couches. Un nouveau papier dans Communications de la nature Par DTU, les chercheurs ajoutent une autre fonctionnalité à la liste: la convexité.

« Nous avons constaté que la convexité est étonnamment courante dans les réseaux profonds et pourrait être une propriété fondamentale qui émerge naturellement à mesure que les machines apprennent », explique Lars Kai Hansen, un professeur DTU Calcul qui a dirigé l'étude.

Pour expliquer brièvement le concept, lorsque nous, les humains, apprenons un «chat», nous ne stockons pas seulement une seule image, mais construisons une compréhension flexible qui nous permet de reconnaître toutes sortes de chats – qu'ils soient grands, petits, moelleux, élégants, noirs, blancs, etc.

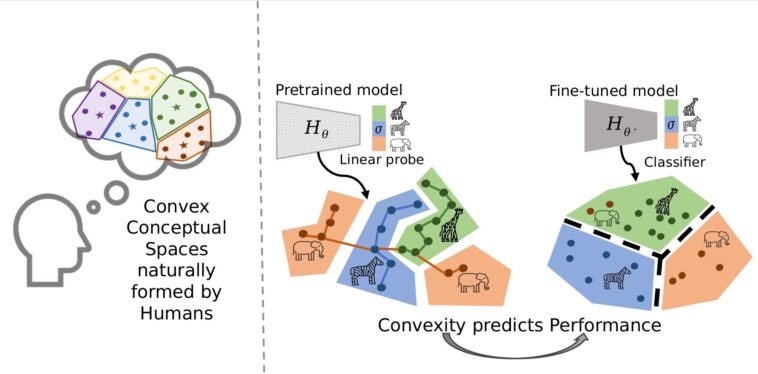

Pris des mathématiques pour décrire – par exemple – la géométrie, le terme convexité a été appliqué aux sciences cognitives par Peter Gärdenfors, qui a proposé que nos cerveaux forment des espaces conceptuels où les idées connexes se regroupent. Et voici la partie cruciale: les concepts naturels, comme « chat » ou « roue », ont tendance à former des régions convexes dans ces espaces mentaux. En bref, on pourrait imaginer un élastique s'étendant autour d'un groupe d'idées similaires – c'est une région convexe.

Pensez-y comme ceci: à l'intérieur du périmètre de l'élastique, si vous avez deux points représentant deux chats différents, n'importe quel point sur le chemin le plus court entre eux se situe également dans la région mentale du « chat ». Une telle convexité est puissante car elle nous aide à généraliser à partir de quelques exemples, à apprendre rapidement de nouvelles choses et nous aide même à communiquer et à convenir de ce que les choses signifient. C'est une propriété fondamentale qui rend l'apprentissage humain robuste, flexible et social.

En ce qui concerne les modèles d'apprentissage en profondeur – les moteurs derrière tout, de la génération d'images aux chatbots – ils apprennent en transformant des données brutes comme des pixels ou des mots en représentations internes complexes, souvent appelées «espaces latents». Ces espaces peuvent être considérés comme des cartes internes où l'IA organise sa compréhension du monde.

Mesurer la structure interne de l'IA

Pour rendre l'IA plus fiable, digne de confiance et aligné avec les valeurs humaines, il est nécessaire de développer de meilleures façons de décrire comment elle représente les connaissances. Par conséquent, il est essentiel de déterminer si les espaces appris en machine sont organisés d'une manière qui ressemble à des espaces conceptuels humains et s'ils forment également des régions convexes pour les concepts.

Le premier auteur de l'article, Lenka Tetkova, qui est postdoctoral chez DTU Compute, a plongé dans cette question même, en examinant deux principaux types de convexité.

Le premier est la convexité euclidienne, qui est simple: si vous prenez deux points dans un concept dans l'espace latent d'un modèle, et que la ligne droite entre eux reste entièrement dans ce concept, alors la région est convexe euclidienne. C'est comme généraliser en mélangeant des exemples connus.

L'autre est la convexité graphique, qui est plus flexible et particulièrement importante pour les géométries incurvées souvent trouvées dans les représentations internes de l'IA. Imaginez un réseau de points de données similaires – si le chemin le plus court entre deux points dans un concept reste entièrement à l'intérieur de ce concept, alors c'est Graph-Convex. Cela reflète comment les modèles peuvent généraliser en suivant la structure naturelle des données.

« Nous avons développé de nouveaux outils pour mesurer la convexité dans les espaces latents complexes de réseaux de neurones profonds. Nous avons testé ces mesures sur divers modèles d'IA et types de données: images, texte, audio, activité humaine et même des données médicales. Nous avons constaté que le même principe géométrique qui aide les humains à former et à partager des concepts – nous dit de façon », dit Tetkova.

L'ordre caché de l'IA

Les chercheurs ont également découvert que les points communs se trouvent dans des modèles pré-étendus qui apprennent des modèles généraux à partir de jeux de données massifs et de modèles affinés qui ont enseigné des tâches spécifiques comme l'identification des animaux. Cela étaye davantage l'affirmation selon laquelle la convexité pourrait être une propriété fondamentale qui émerge naturellement à mesure que les machines l'apprennent.

Lorsque les modèles sont affinés pour une tâche spécifique, la convexité de leurs régions de décision augmente. À mesure que l'IA s'améliore à la classification, ses régions conceptuelles internes deviennent plus clairement convexes, affinant sa compréhension et affaiblissant ses frontières.

De plus, les chercheurs ont découvert que le niveau de convexité dans les concepts d'un modèle pré-entraîné peut prédire dans quelle mesure ce modèle fonctionnera après un réglage fin.

« Imaginez qu'un concept, disons, un chat, forme une belle région convexe bien définie dans la machine avant même qu'il ne soit enseigné à identifier spécifiquement les chats. Ensuite, il est plus susceptible d'apprendre à identifier les chats avec précision plus tard. Nous pensons que c'est un aperçu puissant, car il suggère que le convexité pourrait être un indicateur utile du potentiel d'un modèle pour des tâches d'apprentissage spécifiques, » dit le professeur Hansen.

Une route vers une meilleure IA

Selon les chercheurs, ces nouveaux résultats peuvent avoir plusieurs implications importantes. En identifiant la convexité comme une propriété omniprésente, ils ont mieux compris à quel point les réseaux de neurones profonds apprennent et organisent des informations. Il fournit un mécanisme concret sur la façon dont l'IA se généralise, ce qui peut ressembler à la façon dont les humains apprennent.

Si la convexité s'avère être un prédicteur fiable des performances, il peut être possible de concevoir des modèles d'IA qui encouragent explicitement la formation de régions convexes du concept pendant la formation. Cela pourrait conduire à un apprentissage plus efficace et efficace, en particulier dans les scénarios où seuls quelques exemples sont disponibles. Les résultats peuvent donc fournir un nouveau pont crucial entre la cognition humaine et l'intelligence machine.

« En montrant que les modèles d'IA présentent des propriétés (comme la convexité) qui sont fondamentales pour la compréhension conceptuelle humaine, nous nous rapprochons de la création de machines qui« pensent »de manière plus compréhensible et alignée sur les nôtres. Ceci est vital pour assurer la confiance et la collaboration entre les humains et les machines dans des applications critiques comme les soins de santé, l'éducation et le service public», explique Tetkova.

« Bien qu'il y ait encore beaucoup à explorer, les résultats suggèrent que l'idée apparemment abstraite de la convexité peut contenir la clé pour débloquer de nouveaux secrets sur le fonctionnement interne de l'IA et nous rapprocher des machines intelligentes et alignées sur l'homme. »

La recherche a été menée dans le projet de recherche « Cognitive Spaces – Next Generation explicable IA ». L'objectif du projet est d'ouvrir la boîte noire d'apprentissage automatique et de construire des outils pour expliquer le fonctionnement interne des systèmes AI avec des concepts qui peuvent être compris par des groupes d'utilisateurs spécifiques.