Ce robot hexapode reconnaît son environnement à l'aide d'un système de vision qui occupe moins d'espace de stockage qu'une seule photo sur votre téléphone. L'exécution du nouveau système n'utilise que 10% de l'énergie requise par les systèmes de localisation conventionnels, selon les chercheurs en juin Robotique scientifique.

Un « œil '' aussi faible pourrait être extrêmement utile pour les robots impliqués dans l'espace et l'exploration sous-marine, ainsi que pour les drones ou les microrobots, tels que ceux qui examinent le tube digestif, explique la robotique Yulia Sandamirskaya de l'Université de Zurich des sciences appliquées, qui n'a pas été impliquée dans l'étude.

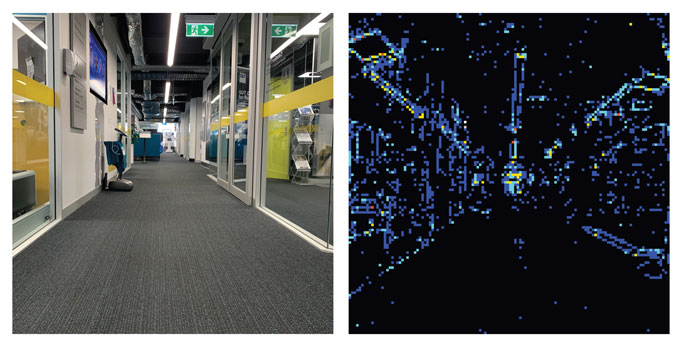

Le système, connu sous le nom d'objectif, se compose d'un capteur, d'une puce et d'un modèle d'IA super-tiny pour apprendre et se souvenir de l'emplacement. La clé du système est le combo Chip and Sensor, appelé Speck, un produit disponible dans le commerce de la société Sysense. Le capteur visuel de Speck fonctionne «plus comme l'œil humain» et est plus efficace qu'un appareil photo, explique le co-auteur de l'étude Adam Hines, biorobotique à l'Université de technologie du Queensland à Brisbane, en Australie.

Les caméras capturent tout dans leur champ visuel plusieurs fois par seconde, même si rien ne change. Les modèles d'IA grand public excellent pour transformer cet énorme tas de données en informations utiles. Mais le combo de la caméra et de la puissance des gardes. La détermination de l'emplacement se déplace jusqu'à un tiers de la batterie d'un robot mobile. «C'est franchement fou que nous nous sommes habitués à utiliser des caméras pour les robots», explique Sandamirskaya.

En revanche, l'œil humain détecte principalement changements Alors que nous passons dans un environnement. Le cerveau met ensuite à jour l'image de ce que nous voyons en fonction de ces changements. De même, chaque pixel du capteur des cches de Speck «ne se réveille que lorsqu'il détecte un changement de luminosité dans l'environnement», dit Hines, il a donc tendance à capturer des structures importantes, comme les bords. Les informations du capteur alimentent un processeur informatique avec des composants numériques qui agissent comme des neurones de dopage dans le cerveau, activant uniquement à mesure que les informations arrivent – un type de calcul neuromorphique.

Le capteur et la puce travaillent avec un modèle d'IA pour traiter les données environnementales. Le modèle d'IA développé par l'équipe de Hines est fondamentalement différent de ceux populaires utilisés pour les chatbots et autres. Il apprend à reconnaître les endroits non pas à partir d'un énorme tas de données visuelles mais en analysant les bords et autres informations visuelles clés provenant du capteur.

Ce combo d'un capteur, processeur et modèle d'IA neuromorphiques donne à l'objectif sa superpuissance de faible puissance. «Des solutions radicalement nouvelles et éconergétiques pour… la reconnaissance de la place sont nécessaires, comme l'objectif», explique Sandamirskaya.