Lorsque l’apprentissage automatique est utilisé pour suggérer de nouvelles connaissances ou orientations scientifiques potentielles, les algorithmes proposent parfois des solutions qui ne sont pas physiquement valables.

Prenez, par exemple, AlphaFold, le système d’IA qui prédit la manière complexe dont les chaînes d’acides aminés se replieront en structures protéiques 3D. Le système suggère parfois des plis « non physiques » – des configurations invraisemblables sur la base des lois de la physique – en particulier lorsqu'on lui demande de prédire les plis de chaînes qui sont significativement différentes de ses données d'entraînement.

Pour limiter ce type de résultat non physique dans le domaine de la conception de médicaments, Anima Anandkumar, professeur Bren d'informatique et de sciences mathématiques à Caltech, et ses collègues ont introduit un nouveau modèle d'apprentissage automatique appelé NucleusDiff, qui intègre une idée physique simple dans sa formation, améliorant considérablement les performances de l'algorithme.

Anandkumar et ses collègues décrivent NucleusDiff dans un article paru dans le cadre d'un dossier spécial « Machine Learning in Chemistry » publié dans Actes de l'Académie nationale des sciences.

L’objectif de la conception de médicaments basés sur la structure est de produire de petites molécules, appelées ligands, qui se lieront bien à une cible biologique, généralement une protéine, provoquant une sorte de changement d’activité souhaité. Les modèles d’IA de conception de médicaments sont formés sur des ensembles de données contenant des dizaines de milliers d’exemples de tels appariements protéine-ligand ainsi que des informations sur la façon dont ils s’accrochent les uns aux autres, une mesure importante appelée affinité de liaison. Mais surtout, NucleusDiff va encore plus loin.

« Avec l'apprentissage automatique, le modèle apprend déjà de nombreux aspects de ce qui constitue une bonne liaison, et maintenant nous intégrons quelques principes physiques simples pour nous assurer d'exclure toutes les choses non physiques », explique Anandkumar.

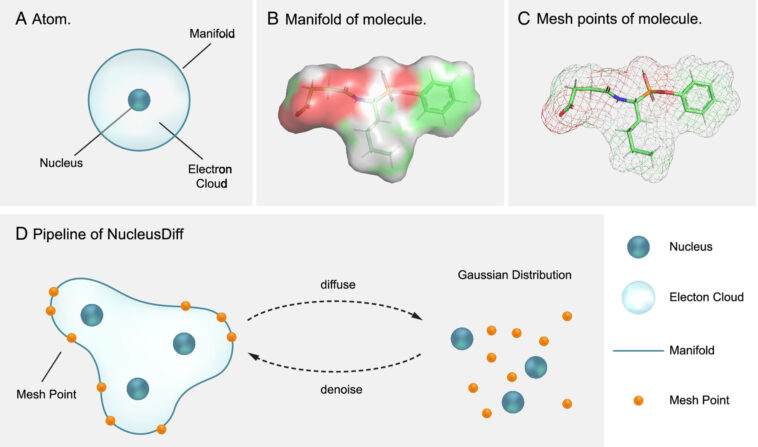

Dans le cas de NucleusDiff, le modèle garantit que les atomes restent à une distance appropriée les uns des autres, en tenant compte de concepts physiques tels que les forces répulsives qui empêchent les atomes de se chevaucher ou d'entrer en collision.

« Nous avons une belle théorie physique derrière l'algorithme, mais elle est également intuitive », explique Anandkumar. « Étonnamment, sans ces contraintes, tous ces modèles d'IA ont tendance à prédire qu'il y a collision, que les atomes se rapprochent trop. En ajoutant de la physique simple, nous avons augmenté la précision du modèle. »

Plutôt que de prendre en compte la distance entre chaque paire d'atomes d'une molécule (une tâche dont le coût de calcul serait prohibitif), NucleusDiff estime une variété, ou enveloppe, une estimation approximative de la distribution des atomes et de l'emplacement probable des électrons dans la molécule. Sur ce collecteur, il établit ensuite des points d'ancrage principaux à surveiller, en s'assurant que les atomes ne se rapprochent jamais trop les uns des autres.

L’équipe a formé NucleusDiff sur un ensemble de données de formation appelé CrossDocked2020, qui comprend environ 100 000 complexes de liaison protéine-ligand. Ils l’ont testé sur 100 de ces complexes et ont constaté qu’il surpassait considérablement les modèles de pointe en termes d’affinité de liaison tout en réduisant le nombre de collisions atomiques à presque zéro.

Ensuite, les chercheurs ont utilisé le nouveau modèle pour prédire les affinités de liaison d’une molécule plus récente qui n’était pas incluse dans l’ensemble de données de formation : la protéase 3CL cible thérapeutique du COVID-19. Encore une fois, NucleusDiff a montré une précision accrue et une réduction des collisions atomiques jusqu'à deux tiers par rapport aux autres modèles leaders.

Ce travail s'inscrit dans le cadre d'une initiative plus large menée sur le campus par Anandkumar et d'autres, à travers une initiative appelée AI4Science, visant à intégrer davantage de physique dans des modèles d'IA basés sur les données et conçus pour une variété de sujets, de la prévision climatique à la robotique et de la sismologie à la modélisation astrophysique.

« Si nous nous appuyons uniquement sur les données d'entraînement, nous ne nous attendons pas à ce que l'apprentissage automatique fonctionne correctement sur des exemples très différents des données d'entraînement », explique Anandkumar.

En fait, dit-elle, c'est un principe standard de l'apprentissage automatique que les résultats relèvent généralement du domaine des exemples fournis dans les données de formation. Mais dans de nombreux domaines scientifiques comme la conception de médicaments, les chercheurs recherchent de nouveaux résultats (par exemple de nouvelles molécules).

« Nous constatons que de nombreux systèmes d'apprentissage automatique échouent à produire des résultats précis sur de nouveaux exemples différents des données d'entraînement, mais en intégrant la physique, nous pouvons rendre l'apprentissage automatique plus fiable et également bien mieux fonctionner », explique Anandkumar.