Dans quelle mesure l'intelligence artificielle est-elle vraiment fiable? Une équipe de recherche interdisciplinaire de Tu Wien a développé une méthode qui permet le calcul exact de la façon dont un réseau neuronal fonctionne de manière fiable dans un domaine d'entrée défini. En d'autres termes: il est désormais possible de garantir mathématiquement que certains types d'erreurs ne se produiront pas – une étape cruciale pour l'utilisation sûre de l'IA dans des applications sensibles.

Des smartphones aux voitures autonomes, les systèmes d'IA sont devenus une partie quotidienne de nos vies. Mais dans les applications où la sécurité est critique, une question centrale se pose: pouvons-nous garantir qu'un système d'IA ne fera pas de graves erreurs – même lorsque son entrée varie légèrement?

Une équipe de Tu Wien – Dr. Andrey Kofnov, le Dr Daniel Kapla, le professeur Efstathia Bura et le professeur Ezio Bartocci – réunissant des experts en mathématiques, en statistiques et en informatique, a maintenant trouvé un moyen d'analyser les réseaux neuronaux, les cerveaux des systèmes d'IA, de manière à ce que la plage possible de productions puisse être déterminée pour une gamme d'entrée donnée – et des erreurs spécifiques peuvent être dirigées avec une certaine production.

Le document est publié sur le arxiv serveur de préimprimée. La recherche a été acceptée pour la présentation à l'ICML 2025.

Petits changements, gros impact?

« Les réseaux de neurones se comportent généralement de manière prévisible – ils donnent la même sortie à chaque fois que vous vous nourrissez dans la même entrée », explique le Dr Kofnov. « Mais dans le monde réel, les entrées sont souvent bruyantes ou incertaines, et ne peuvent pas toujours être décrites par une seule valeur fixe. Cette incertitude dans l'entrée conduit à l'incertitude dans la sortie. »

« Imaginez un réseau neuronal qui reçoit une image en entrée et est chargé d'identifier l'animal », explique le professeur Ezio Bartocci. « Que se passe-t-il si l'image est légèrement modifiée? Une caméra différente, un peu plus de bruit, des changements d'éclairage – cela pourrait faire en sorte que l'IA classe soudainement ce qu'elle voit? »

« La compréhension de la gamme complète de sorties possibles aide à prendre des décisions meilleures et plus sûres, en particulier dans des domaines à enjeux élevés comme la finance, les soins de santé ou l'ingénierie », ajoute Kofnov. « En calculant la probabilité d'éventuels résultats, nous pouvons répondre à des questions importantes comme: quelle est la chance d'un résultat extrême? Combien de risques est impliqué? »

Ces types de questions sont difficiles à répondre en utilisant des tests conventionnels. Bien que de nombreux scénarios puissent être essayés, la couverture complète de toutes les entrées possibles est pratiquement impossible. Il peut toujours y avoir des cas de bord rare qui n'ont pas été testés – et dans lesquels le système échoue.

Mathématiques en espace multidimensionnel

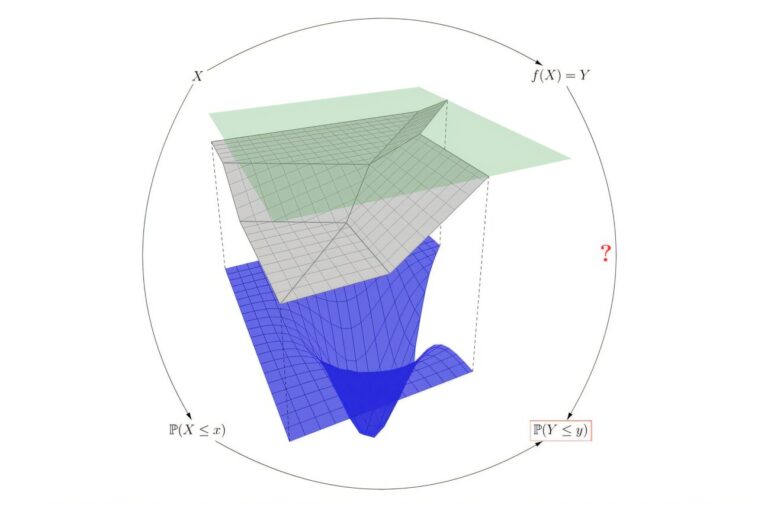

La solution développée chez Tu Wien utilise une approche géométrique: « L'ensemble de toutes les entrées possibles – par exemple, toutes les images possibles qui pourraient être introduites dans un tel système d'IA – peuvent être imaginées comme un espace géométriquement similaire à notre monde en 3 dimensions, mais avec un nombre arbitraire de dimensions », explique le professeur Bura. « Nous partitions cet espace multidimensionnel en sous-régions plus petites, dont chacune peut être analysée avec précision pour déterminer les sorties que le réseau neuronal produira pour les entrées de cette région. »

Cela permet de quantifier mathématiquement la probabilité d'une gamme de sorties – excluant potentiellement des résultats erronés avec une certitude à 100%.

La théorie n'est pas encore applicable aux réseaux de neurones à grande échelle, tels que les modèles de gros langues. « Une IA comme Chatgpt est beaucoup trop complexe pour cette méthode. L'analyser cela nécessiterait une quantité inimaginable de puissance de calcul », explique Kapla. « Mais nous avons montré qu'au moins pour les petits réseaux de neurones, une quantification d'erreur rigoureuse est possible. »

La méthode a été développée dans le cadre du SECINT Doctoral College de Tu Wien, qui favorise la collaboration interdisciplinaire dans le domaine de la sécurité informatique. Les problèmes éthiques et l'impact sociétal de la technologie jouent également un rôle central dans le programme.

Le professeur Bartocci et le professeur Bura ont travaillé avec le Dr Kofnov (ancien doctorat et postdoc actuel) et le Dr Kapla (postdoc) pour développer cette nouvelle méthode, combinant des idées à partir de la théorie de l'IA, des statistiques et des méthodes formelles.