Les réseaux de neurones profonds (DNN), les algorithmes d'apprentissage automatique sous-tendent le fonctionnement de modèles de grands langues (LLM) et d'autres modèles d'intelligence artificielle (IA), apprenez à faire des prédictions précises en analysant de grandes quantités de données. Ces réseaux sont structurés en couches, chacune transformant les données d'entrée en «fonctionnalités» qui guident l'analyse de la couche suivante.

Le processus par lequel DNNS apprend les caractéristiques a fait l'objet de nombreuses études de recherche et est finalement la clé des bonnes performances de ces modèles sur une variété de tâches. Récemment, certains informaticiens ont commencé à explorer la possibilité de modéliser l'apprentissage des fonctionnalités dans les DNN à l'aide de cadres et d'approches ancrés dans la physique.

Des chercheurs de l'Université de Bâle et de l'Université des sciences et de la technologie de Chine ont découvert un diagramme de phases, un graphique ressemblant à ceux utilisés dans la thermodynamique pour délimiter les phases liquides, gazeuses et solides de l'eau, qui représente comment les DNN apprennent les caractéristiques dans diverses conditions. Leur article, publié dans Lettres d'examen physiquemodélise un DNN comme chaîne de blocs de ressort, un système mécanique simple qui est souvent utilisé pour étudier les interactions entre les forces linéaires (printemps) et non linéaires (frottement).

« Cheng et moi étions dans un atelier où il y a eu une conversation inspirante sur » une loi de séparation des données « , » Ivan Dokmanić, le chercheur qui a dirigé l'étude, a déclaré à Issues.fr. «Les couches d'un réseau de neurones profond (mais aussi de réseaux de neurones biologiques tels que le cortex visuel humain) traitent les entrées en les distillant progressivement et en les simplifiant.

«Plus vous êtes profondément dans le réseau, plus ces représentations sont régulières et géométriques, ce qui signifie que les représentations de différentes classes d'objets (par exemple, les représentations des chats et des chiens) deviennent plus séparées et plus faciles à distinguer. Il existe un moyen de mesurer cette séparation.

« Le discours a montré que dans les réseaux neuronaux bien formés, il arrive souvent que ces » statistiques sommaires « de séparation des données se comportent de manière simple, même pour des réseaux neuronaux profonds très compliqués formés sur des données compliquées: chaque couche améliore la séparation de la même quantité. »

L'équipe a constaté que la «loi de la séparation des données» était vraie dans les réseaux avec des «hyperparamètres» couramment utilisés, tels que le taux d'apprentissage et le bruit, mais pas pour différents choix d'hyperparamètre. Ils ont réalisé que comprendre pourquoi cela se produit pourrait éclairer la façon dont les DNN apprennent de bonnes caractéristiques à travers les modèles. Ils ont donc décidé de trouver une description théorique appropriée de ces découvertes intriguées.

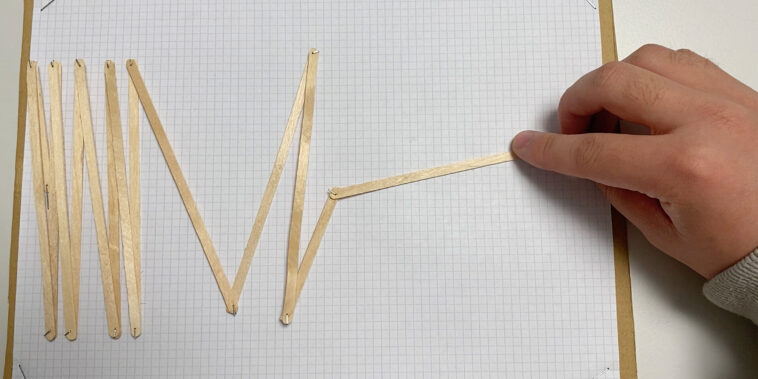

« Dans le même temps, nous avons été impliqués dans certains projets en géophysique où les gens utilisent des modèles de blocs de printemps comme modèles phénoménologiques de dynamique de défaut et de tremblement de terre », a déclaré Dokmanić. « La phénoménologie de séparation des données nous a rappelé cela. Nous avons pensé à de nombreuses autres analogies. Par exemple, Cheng pensait qu'une séparation égale des données est un peu comme un cintre rétractable; je pensais que c'était un peu comme une règle pliante.

« Nous avons passé ces vacances d'hiver à échanger des photos et des vidéos de divers articles et outils ménagères« structurés par des couches », y compris ces cintres, les règles de pliage, etc. Je me souviens avoir discuté de si un certain trivet stretch est un bon modèle pour un célèbre filet de neural profond appelé Resnet. »

Après avoir identifié divers modèles théoriques potentiels et systèmes physiques en couches qui pourraient être utilisés pour étudier comment les DNN apprennent les caractéristiques, les chercheurs ont finalement décidé de se concentrer sur les modèles de blocs de ressort. Ces modèles se sont déjà révélés précieux pour étudier un large éventail de phénomènes du monde réel, y compris les tremblements de terre et la déformation des matériaux.

« Nous avons montré que le comportement de cette séparation des données est étrangement similaire au comportement des blocs connectés par des ressorts qui glissent sur une surface rugueuse (mais aussi au comportement d'autres systèmes mécaniques, tels que les dirigeants de pliage) », a expliqué Dokmanić.

« La quantité de couche simplifie le montant à quel point un ressort s'étend. La non-linéarité dans le réseau correspond à la quantité de frottement entre les blocs et la surface. Dans les deux systèmes, nous pouvons ajouter du bruit. »

En examinant les deux systèmes dans le contexte de la loi de la séparation des données, Dokmanić et ses collègues ont constaté que le comportement des DNN était similaire à celui des chaînes de blocs de printemps. Un DNN répond à la perte de formation (c'est-à-dire demander d'expliquer les données observées) en séparant la couche de données par couche. De même, une chaîne de blocs de ressort répond à une force de traction en séparant la couche de blocs par couche.

« Plus il y a de non-linéarité, plus il y a une différence entre les couches extérieures (profondes) et intérieures (superficielles): les couches profondes apprennent / se séparent plus; même pour les ressorts », a déclaré Dokmanić.

« Cependant, si nous ajoutons le bruit d'entraînement ou commençons à secouer / vibrer le système de sprintes-blocs, alors les blocs passeront un peu de temps » dans l'air « , sans subir de frottement, et cela permettra aux ressorts d'égaliser un peu la séparation. Il est en fait similaire à la` `lubrification acoustique '' en génie des processus, ainsi qu'à certains phénomènes de grenouet en géant ». «

Cette étude récente présente une nouvelle approche théorique pour étudier les DNN et comment ils apprennent les caractéristiques au fil du temps. À l'avenir, cette approche pourrait aider à approfondir la compréhension actuelle des algorithmes d'apprentissage en profondeur et les processus par lesquels ils apprennent à lutter contre de manière fiable des tâches spécifiques.

« La plupart des résultats existants traitent les réseaux simplifiés qui manquent des aspects clés des réels de réels de profondeurs utilisés dans la pratique – en profondeur ou en non-linéarité ou autre chose », a expliqué Dokmanić.

« Ces travaux étudient un seul facteur d'impact sur un modèle stylisé, mais le succès des réseaux profonds est fondé sur une accumulation de facteurs (profondeur, non-linéarité, bruit, taux d'apprentissage, normalisation,…). En revanche, nous avons adopté une approche de haut en bas qui est phénoménologique, pas en premier principe, mais nous obtenons une théorie générale, une compréhension de l'interaction de toutes ces choses. »

La théorie du bloc de printemps employée par les chercheurs s'est avérée à la fois simple et efficace pour comprendre la capacité des DNN à généraliser dans différents scénarios. Dans leur article, Dokmanić et ses collègues l'ont utilisé avec succès pour calculer les courbes de séparation des données des DNN pendant la formation et ont constaté que la forme de ces courbes indique les performances du réseau formé sur les données invisibles.

« Puisque nous comprenons également comment changer la forme de la courbe de séparation des données dans les deux sens par un bruit et une non-linéarité variables, cela nous donne un outil (potentiellement) puissant pour accélérer l'entraînement de très grands filets », a déclaré Dokmanić.

« La plupart des gens ont de fortes intuitions sur les ressorts et les blocs, mais pas sur les réseaux neuronaux profonds. Notre théorie dit que nous pouvons faire des déclarations intéressantes et utiles sur les réseaux profonds en tirant notre intuition sur un système mécanique simple. C'est génial parce que les filets neuronaux ont des milliards de paramètres, mais notre système de blocs de ressort n'a qu'une poignée. »

Le modèle théorique utilisé par cette équipe de chercheurs pourrait bientôt être utilisé par les théoriciens et les informaticiens pour étudier plus avant les fondements des algorithmes basés sur l'apprentissage en profondeur. Dans le cadre de leurs prochaines études, Dokmanić et ses collègues espèrent également utiliser leur approche théorique pour explorer l'apprentissage des caractéristiques d'un point de vue microscopique.

« Nous sommes sur le point d'avoir une explication des premiers principes de la phénoménologie du bloc de printemps (ou peut-être la phénoménologie du souverain pliant) dans les réseaux profonds et non linéaires donnent ou prennent quelques approximations », a expliqué Dokmanić.

« L'autre direction que nous poursuivons est de vraiment doubler la façon d'opération pour améliorer la formation en filet profonde, en particulier pour les réseaux très importants basés sur des transformateurs comme les modèles de grande langue. Avoir une procuration pour la généralisation qui est bon marché à calculer au moment de la formation, et une compréhension de la façon d'offrir une formation pour améliorer la généralisation, est une sorte de Saint Graal, une voie alternative à la mise à l'échelle actuellement très populaire. »

En comprenant comment la formation des DNN peut être soigneusement conçue pour améliorer leur capacité à généraliser entre d'autres tâches, les chercheurs pourraient également concevoir un outil de diagnostic pour les grands réseaux neuronaux. Par exemple, cet outil pourrait aider à identifier les zones qui doivent être améliorées pour augmenter les performances d'un modèle, de la même manière que la façon dont les cartes de stress sont utilisées en mécanique structurelle pour identifier les régions de contrainte concentrée qui pourraient compromettre la sécurité des structures.

« En analysant la distribution de charge interne dans un filet neuronal, nous pouvons trouver des couches / régions qui sont surchargées, ce qui peut indiquer une sur-ajustement et nuire à la généralisation, ou des couches qui sont à peine utilisées, indiquant la redondance », a ajouté Dokmanić.

Écrit pour vous par notre auteur Ingrid Fadelli, édité par Gaby Clark, et vérifié et examiné par Robert Egan – cet article est le résultat d'un travail humain minutieux. Nous comptons sur des lecteurs comme vous pour garder le journalisme scientifique indépendant en vie. Si ce rapport vous importe, veuillez considérer un don (surtout mensuel). Vous obtiendrez un sans publicité compte comme un remerciement.