Des chercheurs de Cambridge mettent en garde contre les dangers psychologiques des « robots morts », une IA qui imite les individus décédés, et demandent instamment des normes éthiques et des protocoles de consentement pour prévenir les abus et garantir une interaction respectueuse.

Selon des chercheurs de l’Université de Cambridge, l’intelligence artificielle qui permet aux utilisateurs d’avoir des conversations textuelles et vocales avec des proches disparus risque de causer des dommages psychologiques et même de « hanter » numériquement ceux qui sont laissés pour compte sans normes de sécurité de conception.

Les « Deadbots » ou « Griefbots » sont des chatbots IA qui simulent les modèles linguistiques et les traits de personnalité des morts en utilisant les empreintes numériques qu'ils laissent derrière eux. Certaines entreprises proposent déjà ces services, offrant un tout nouveau type de « présence post-mortem ».

Les éthiciens de l'IA du Leverhulme Center for the Future of Intelligence de Cambridge présentent trois scénarios de conception de plates-formes qui pourraient émerger dans le cadre du développement de « l'industrie numérique de l'au-delà », afin de montrer les conséquences potentielles d'une conception imprudente dans un domaine de l'IA qu'ils décrivent comme « à haut risque ». .»

Utilisation abusive des chatbots IA

La recherche, publiée dans la revue Philosophie et technologiemet en évidence la possibilité pour les entreprises d'utiliser des robots morts pour annoncer subrepticement des produits aux utilisateurs à la manière d'un être cher décédé, ou pour angoisser les enfants en insistant sur le fait qu'un parent décédé est toujours « avec vous ».

Lorsque les vivants s’inscrivent pour être virtuellement recréés après leur mort, les chatbots qui en résultent pourraient être utilisés par les entreprises pour envoyer des spams à leurs familles et amis survivants avec des notifications, des rappels et des mises à jour non sollicités sur les services qu’ils fournissent – un peu comme si les morts étaient « traqués » numériquement. .»

Même ceux qui trouvent un premier réconfort auprès d'un « robot mort » peuvent être épuisés par des interactions quotidiennes qui deviennent un « poids émotionnel écrasant », affirment les chercheurs, mais ils peuvent également être impuissants face à la suspension d'une simulation d'IA si leur proche, aujourd'hui décédé, signait un long contrat. contrat avec un service numérique d’au-delà.

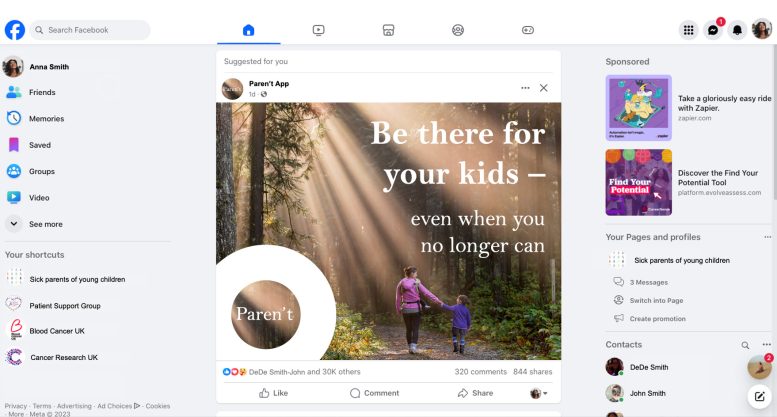

Une visualisation d'une entreprise fictive appelée MaNana, l'un des scénarios de conception utilisés dans le document pour illustrer les problèmes éthiques potentiels dans l'industrie émergente de l'au-delà numérique. Crédit : Dr Tomasz Hollanek

« Les progrès rapides de l'IA générative signifient que presque toute personne disposant d'un accès à Internet et d'un certain savoir-faire de base peut ressusciter un être cher décédé », a déclaré le Dr Katarzyna Nowaczyk-Basińska, co-auteur de l'étude et chercheuse au Leverhulme Center for the Future of Intelligence de Cambridge ( LCFI). « Ce domaine de l’IA est un champ de mines éthique. Il est important de donner la priorité à la dignité des défunts et de veiller à ce qu'elle ne soit pas empiété par des motivations financières liées aux services numériques d'au-delà, par exemple. Dans le même temps, une personne peut laisser une simulation d’IA comme cadeau d’adieu à ses proches qui ne sont pas prêts à gérer leur chagrin de cette manière. Les droits des donneurs de données et de ceux qui interagissent avec les services d’IA après la mort doivent être également protégés.

Services existants et scénarios hypothétiques

Des plateformes proposant de recréer les morts avec l'IA pour une somme modique existent déjà, comme le « Projet Décembre », qui a commencé par exploiter des modèles GPT avant de développer ses propres systèmes, et des applications comme « HereAfter ». Des services similaires ont également commencé à émerger en Chine. L'un des scénarios potentiels du nouvel article est « MaNana » : un service d'IA conversationnelle permettant aux gens de créer un robot mort simulant leur grand-mère décédée sans le consentement du « donneur de données » (le grand-parent décédé).

Le scénario hypothétique voit un petit-enfant adulte initialement impressionné et réconforté par la technologie commencer à recevoir des publicités une fois un « essai premium » terminé. Par exemple, le chatbot propose de commander auprès des services de livraison de nourriture avec la voix et le style du défunt. Le parent estime qu'il a manqué de respect à la mémoire de sa grand-mère et souhaite que le robot mort soit désactivé, mais de manière significative – ce que les prestataires de services n'ont pas envisagé.

Une visualisation d'une entreprise fictive appelée Paren't. Crédit : Dr Tomasz Hollanek

« Les gens pourraient développer des liens émotionnels forts avec de telles simulations, ce qui les rendrait particulièrement vulnérables à la manipulation », a déclaré le co-auteur, le Dr Tomasz Hollanek, également du LCFI de Cambridge. « Des méthodes et même des rituels permettant de retirer dignement les robots morts devraient être envisagés. Il peut s’agir par exemple d’une forme d’enterrement numérique ou d’autres types de cérémonies selon le contexte social. Nous recommandons de concevoir des protocoles qui empêchent que les robots morts soient utilisés de manière irrespectueuse, par exemple à des fins publicitaires ou pour avoir une présence active sur les réseaux sociaux.

Alors que Hollanek et Nowaczyk-Basińska affirment que les concepteurs de services de recréation devraient activement rechercher le consentement des donneurs de données avant de les transmettre, ils soutiennent qu'une interdiction des robots morts basée sur des donateurs non consentants serait irréalisable.

Ils suggèrent que les processus de conception devraient impliquer une série d'invites pour ceux qui cherchent à « ressusciter » leurs proches, telles que « avez-vous déjà parlé avec X de la façon dont ils aimeraient qu'on se souvienne d'eux ? », afin que la dignité des défunts soit au premier plan. dans le développement de robots morts.

Restrictions d'âge et transparence

Un autre scénario présenté dans le journal, une entreprise imaginaire appelée « Paren't », met en avant l'exemple d'une femme en phase terminale quittant un robot mort pour aider son fils de huit ans dans son processus de deuil.

Alors que le robot mort constitue initialement une aide thérapeutique, l’IA commence à générer des réponses déroutantes à mesure qu’elle s’adapte aux besoins de l’enfant, par exemple en décrivant une rencontre imminente en personne.

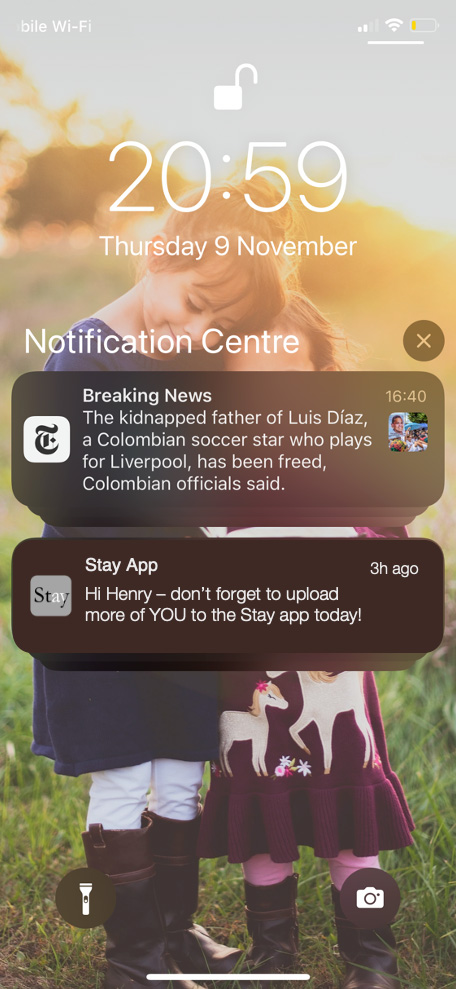

Une visualisation d'une entreprise fictive appelée Stay. Crédit : Dr Tomasz Hollanek

Les chercheurs recommandent des restrictions d’âge pour les robots morts et appellent également à une « transparence significative » pour garantir que les utilisateurs soient systématiquement conscients qu’ils interagissent avec une IA. Celles-ci pourraient s’apparenter aux avertissements actuels sur les contenus susceptibles de provoquer des saisies, par exemple.

Le dernier scénario exploré par l'étude – une société fictive appelée « Stay » – montre une personne âgée s'engageant secrètement dans un robot mort et payant un abonnement de vingt ans, dans l'espoir que cela réconforte ses enfants adultes et permette à ses petits-enfants de les connaître.

Après la mort, le service entre en jeu. Un enfant adulte ne s'engage pas et reçoit un barrage d'e-mails avec la voix de son parent décédé. Un autre le fait, mais finit par être épuisé émotionnellement et rongé par la culpabilité face au sort du robot mort. Pourtant, suspendre le robot mort violerait les termes du contrat que leur parent a signé avec la société de services.

« Il est essentiel que les services numériques d'après-vie prennent en compte les droits et le consentement non seulement de ceux qu'ils recréent, mais aussi de ceux qui devront interagir avec les simulations », a déclaré Hollanek.

« Ces services courent le risque de causer une énorme détresse aux gens s’ils sont soumis à des hantises numériques indésirables provenant de recréations IA d’une précision alarmante de ceux qu’ils ont perdus. L’effet psychologique potentiel, en particulier dans une période déjà difficile, pourrait être dévastateur. »

Les chercheurs appellent les équipes de conception à donner la priorité aux protocoles de désinscription qui permettent aux utilisateurs potentiels de mettre fin à leurs relations avec les robots morts de manière à mettre un terme à leurs émotions.

Nowaczyk-Basińska a ajouté : « Nous devons commencer à réfléchir dès maintenant à la manière dont nous atténuons les risques sociaux et psychologiques de l'immortalité numérique, car la technologie est déjà là. »