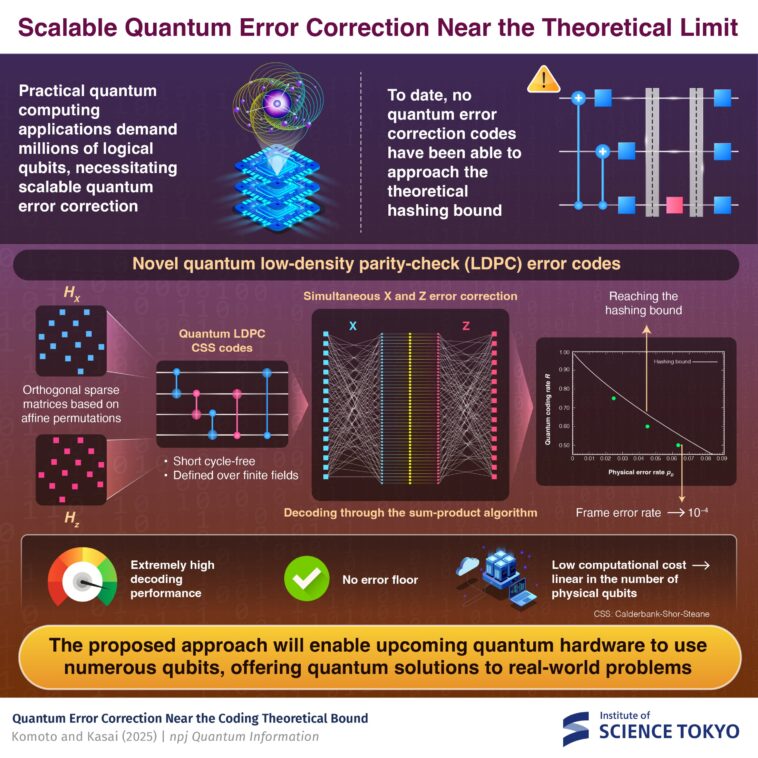

Une nouvelle classe de codes de correction d'erreurs de parité à basse densité hautement efficaces et évolutives, capables de performances approchant la limite de hachage théorique, a été développée par des scientifiques de l'Institut des sciences, Tokyo, Japon. Ces nouveaux codes de correction d'erreur peuvent gérer les codes quantiques avec des centaines de milliers de qubits, permettant potentiellement le calcul quantique tolérant aux pannes à grande échelle, avec des applications dans divers domaines, notamment la chimie quantique et les problèmes d'optimisation.

Ces dernières années, les ordinateurs quantiques ont commencé à gérer des bits quantiques à deux chiffres ou des qubits. Cependant, de nombreuses applications essentielles ciblées par des ordinateurs quantiques, tels que la chimie quantique, la cryptographie, etc., exigent des millions ou encore plus de qubits logiques. La mise à l'échelle de ces nombres est un défi majeur, car les ordinateurs quantiques souffrent d'erreurs inhérentes qui augmentent rapidement avec le nombre de qubits.

Pour l'informatique quantique pratique, des méthodes de correction quantique très efficaces qui peuvent accueillir un grand nombre de qubits logiques sont nécessaires. Malheureusement, les méthodes de correction des erreurs quantiques actuelles sont extrêmement à forte intensité de ressources, en s'appuyant sur des codes essentiellement zéro-taux. En conséquence, seule une petite fraction de qubits logiques fiables peut être extraite d'un nombre extrêmement important de qubits physiques.

Les plus grands obstacles à l'échelle des ordinateurs quantiques sont les défis d'ingénierie liés aux technologies de stabilité et de contrôle des appareils.

Ceux-ci incluent les temps de cohérence courts des qubits, les taux d'erreur élevés dans les opérations et les mesures des portes, les interactions limitées entre les qubits et les difficultés associées à des technologies d'intégration et de refroidissement à grande échelle. Chacun d'eux représente un goulot d'étranglement fondamental dans la construction d'un grand nombre de qubits logiques fiables.

Cependant, même dans un paramètre idéalisé où ces limitations au niveau de l'appareil sont supprimées, la conception de codes de correction d'erreur quantique a fait face à de grands défis non résolus. Ceux-ci incluent des taux de codage faibles et le manque de phénomènes de seuil pointus qui limitent les améliorations des performances. Des défis supplémentaires incluent la stagnation des performances dans la région de la fiabilité élevée en raison de planchers d'erreur – un écart significatif de la limite de hachage théorique et la nécessité d'un post-traitement coûteux après décodage de propagation de croyance.

Bien que la mise à l'échelle soit essentielle pour résoudre des problèmes pratiques avec les ordinateurs quantiques, il est également connu théoriquement que la correction d'erreur quantique s'améliore avec l'échelle. Pourtant, jusqu'à présent, aucun codes quantique n'avait été découvert qui pourrait vraiment exploiter les avantages des systèmes quantiques à grande échelle.

Dans la théorie des informations classiques, il existe des codes de correction d'erreur très efficaces, appelés codes de vérification de parité à basse densité (LDPC), qui peuvent aborder la limite de performance théorique.

Alors que de nombreuses études ont tenté de développer des codes de correction d'erreur LDPC quantiques, à ce jour, aucun n'a pu aborder la limite de hachage, la quantité théorique maximale d'informations qui peuvent être transmises sur un canal quantique, qui sert de référence pour les performances de correction d'erreur quantique.

Dans une récent percée, le professeur agrégé Kenta Kasai et l'étudiant de Master, M. Daiki Komoto, du Département de génie de l'information et des communications, School of Engineering at Institute of Science Tokyo (Science Tokyo), Japon, ont développé avec succès de nouveaux codes de correction quantique LDPC, capables d'approcher le hachage lié, tout en conservant une grande efficacité LDPC.

« Notre code de correction des erreurs quantique a un taux de code supérieur à 1/2, ciblant des centaines de milliers de qubits logiques », explique Kasai. « De plus, sa complexité de décodage est proportionnelle au nombre de qubits physiques, qui est une réalisation significative pour l'évolutivité quantique. »

Leur étude est publiée dans la revue Informations quantiques NPJ.

Les chercheurs ont commencé par construire des codes LDPC Protographie, qui sont connus pour avoir d'excellentes performances de correction d'erreur. Ils ont introduit une nouvelle technique de construction basée sur des permutations affine, ce qui améliore la diversité de la structure du code et évite les cycles courts, qui sont connus pour affecter négativement les performances du décodage.

Contrairement aux codes LDPC conventionnels, qui sont définis sur des champs finis binaires, ces nouveaux codes sont définis sur des champs finis non binaires. Cela signifie que ces codes peuvent transporter plus d'informations, améliorant les performances de décodage. Ces codes de protographie ont ensuite été transformés en codes Calderbank-Shor-Steane, une famille bien connue de codes de correction d'erreur quantique.

De plus, les chercheurs ont développé une nouvelle méthode de décodage efficace en utilisant l'algorithme de produit de somme bien connu. Cette méthode gère les erreurs de flip bit (x) et de phase (z), les deux erreurs fondamentales dans l'informatique quantique, simultanément. Toute erreur dans un état quantique peut être corrigée en abordant ces erreurs. À titre de comparaison, la plupart des codes de correction d'erreur précédents ne gèrent qu'un seul type d'erreur à la fois.

En conséquence, dans des simulations numériques à grande échelle, ces nouveaux codes de correction d'erreur ont atteint des performances de décodage extrêmement élevées, démontrant un taux d'erreur d'image aussi faible que 10−4même pour les codes avec des centaines de milliers de qubits.

Cette performance est assez proche de la limite de hachage, représentant une réalisation significative. Surtout, ces codes de correction d'erreur ont une complexité de décodage proportionnelle au nombre de qubits, ce qui les rend très efficaces et évolutives pour l'informatique quantique à grande échelle.

« Nos codes de correction d'erreur LDPC quantiques peuvent potentiellement permettre aux ordinateurs quantiques d'équilibrer jusqu'à des millions de qubits logiques », remarque Kasai.

« Cela améliorera considérablement la fiabilité et l'évolutivité des ordinateurs quantiques pour les applications pratiques tout en ouvrant la voie à de futures recherches. »

Dans l'ensemble, cette étude représente une avancée majeure pour le développement d'ordinateurs quantiques tolérants aux pannes pour des applications pratiques, bénéficiant de nombreux domaines.