Une nouvelle étude co-dirigée par l'Université d'Oxford et Google Cloud a montré comment l'IA à usage général peut classer avec précision les changements réels dans le ciel nocturne – tels qu'une étoile explosive, un trou noir déchirant une étoile passagère, un astéroïde à évolution rapide ou une brève poussée stellaire d'un système d'étoiles compact – et expliquer son raisonnement, sans avoir besoin d'un entraînement complexe.

Publié dans Astronomie naturellel'étude des chercheurs de l'Université d'Oxford, de Google Cloud et de l'Université Radboud démontre qu'un modèle de grande langue à usage général (LLM) – Gémeaux de Google – peut être transformé en un assistant d'astronomie expert avec des conseils minimaux.

En utilisant seulement 15 exemples d'images et un simple ensemble d'instructions, Gemini a appris à distinguer les événements cosmiques réels des artefacts d'imagerie avec une précision d'environ 93%. Surtout, l'IA a également fourni une explication claire à l'anglais pour chaque classification – une étape importante vers la renforce des sciences axée sur l'IA plus transparente et digne de confiance, et vers la création d'outils accessibles qui ne nécessitent pas d'ensembles de données de formation massifs ou d'expertise approfondie dans la programmation d'IA.

« Il est frappant qu'une poignée d'exemples et d'instructions claires de texte puissent fournir une telle précision », a déclaré le Dr Fiorenzo Stoppa, co-dirigeant, du Département de physique de l'Université d'Oxford. « Cela permet à un large éventail de scientifiques de développer leurs propres classificateurs sans expertise approfondie dans la formation des réseaux de neurones – seulement la volonté d'en créer un. »

« En tant que personne sans formation formelle en astronomie, cette recherche est incroyablement excitante », a déclaré Turan Bulmus, co-dirigeant l'auteur de Google Cloud. « Il démontre comment les LLM à usage général peuvent démocratiser la découverte scientifique, permettant à toute personne de curiosité de contribuer de manière significative aux domaines dans lesquels ils pourraient ne pas avoir de formation traditionnelle. C'est un témoignage du pouvoir de l'IA accessible pour décomposer les barrières de la recherche scientifique. »

Signaux rares dans un univers de bruit

Les télescopes modernes scannent le ciel sans relâche, générant des millions d'alertes chaque nuit sur les changements potentiels. Bien que certains d'entre eux soient de véritables découvertes comme les étoiles explosives, la grande majorité sont des signaux « faux » causés par des sentiers satellites, des tubes à rayons cosmiques ou d'autres artefacts instrumentaux.

Traditionnellement, les astronomes se sont appuyés sur des modèles d'apprentissage automatique spécialisés pour filtrer ces données. Cependant, ces systèmes fonctionnent souvent comme une « boîte noire », fournissant une simple étiquette « réelle » ou « bidon » sans expliquer leur logique. Cela oblige les scientifiques à faire aveuglément faire confiance à la production ou à passer d'innombrables heures à vérifier manuellement des milliers de candidats – une tâche qui deviendra impossible avec la prochaine génération de télescopes tels que l'Observatoire Vera C. Rubin, qui sortira environ 20 téraoctets de données toutes les 24 heures.

L'équipe de recherche a posé une question simple: une IA multimodale à usage général pourrait-elle pourrait-elle comprendre le texte et les images ensemble, non seulement correspondre à la précision des modèles spécialisés, mais aussi expliquer ce qu'elle voit?

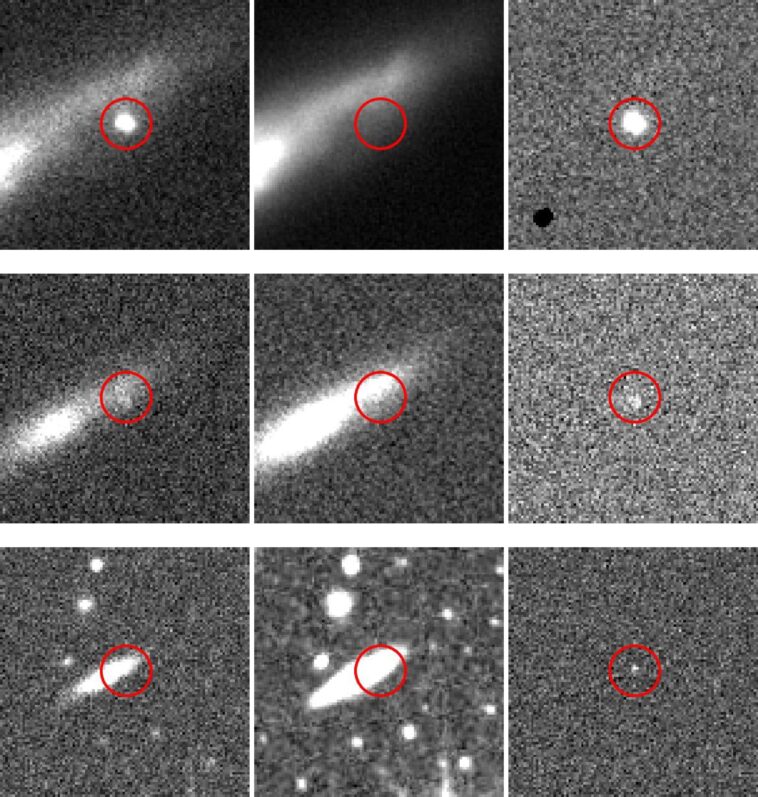

L'équipe a fourni au LLM seulement 15 exemples étiquetés pour chacun des trois principaux enquêtes Sky (Atlas, Meerlicht et Pan-Starrs). Chaque exemple comprenait une petite image d'une nouvelle alerte, une image de référence du même patch de ciel et une image « différence » mettant en évidence le changement, ainsi qu'une brève note d'expert. Guidé uniquement par ces exemples de coups et instructions concises, le modèle a ensuite classé des milliers de nouvelles alertes, fournissant une étiquette (réel / fausse), un score de priorité et une description courte et lisible de sa décision.

Un humain dans la boucle: une IA qui sait quand demander de l'aide

Un élément clé de l'étude a été la vérification de la qualité et de l'utilité des explications de l'IA. L'équipe a rassemblé un panel de 12 astronomes pour revoir les descriptions de l'IA, qui les ont jugées très cohérentes et utiles.

De plus, dans un test parallèle, l'équipe a demandé à Gemini de réviser ses propres réponses et d'attribuer un score de cohérence à chacun. Ils ont découvert que la confiance du modèle était un puissant indicateur de sa précision: les sorties à faible cohérence étaient beaucoup plus susceptibles d'être incorrectes. Cette capacité d'auto-évaluation est essentielle pour construire un flux de travail fiable « humain en boucle ». En signalant automatiquement ses propres cas incertains pour une revue humaine, le système peut concentrer l'attention des astronomes là où il est le plus nécessaire.

En utilisant cette boucle d'auto-correction pour affiner les exemples initiaux, l'équipe a amélioré les performances du modèle sur un ensemble de données de ~ 93,4% à ~ 96,7%, démontrant comment le système peut apprendre et améliorer en partenariat avec des experts humains.

Le co-auteur, le professeur Stephen Smartt (Département de physique, Université d'Oxford), a déclaré: « J'ai travaillé sur ce problème de traitement rapide des données des enquêtes Sky depuis plus de 10 ans, et nous sommes constamment en proie à l'élimination des événements réels des signaux de faux dans le traitement des données. Nous avons passé des années à entraîner des modèles d'apprentissage, des réseaux neuraux, pour faire la reconnaissance de l'image.

« Cependant, la précision de la LLM à reconnaître les sources avec un minimum de conseils plutôt que la formation spécifique à la tâche était remarquable. Si nous pouvons ingénieurs pour évoluer cela, cela pourrait être un changement de jeu total pour le domaine, un autre exemple de l'IA permettant une découverte scientifique. »

Quelle est la prochaine étape?

L'équipe envisage cette technologie comme le fondement des «assistants agentiques» autonomes en science. Ces systèmes pourraient faire bien plus que classer une seule image; Ils pourraient intégrer plusieurs sources de données (comme les images et les mesures de luminosité), vérifier leur propre confiance, demander de manière autonome les observations de suivi des télescopes robotiques et augmenter uniquement les découvertes les plus prometteuses et les plus inhabituelles des scientifiques humains.

Étant donné que la méthode ne nécessite qu'un petit ensemble d'exemples et des instructions en langue simple, il peut être rapidement adapté pour de nouveaux instruments scientifiques, enquêtes et objectifs de recherche dans différents domaines.

« Nous entrons dans une époque où la découverte scientifique est accélérée non pas par les algorithmes de la boîte noire, mais par des partenaires d'IA transparents », a déclaré Turan Bulmus, co-chef de Google Cloud.

« Ce travail montre une voie vers les systèmes qui apprennent avec nous, expliquent leur raisonnement et permettent aux chercheurs dans n'importe quel domaine de se concentrer sur ce qui compte le plus: poser la prochaine grande question. »