Le Web est inondé de robots qui grattent les données sans autorisation. Maintenant, les créateurs de contenu empoisonnent le puits de l'intelligence artificielle – mais une technologie similaire peut également être utilisée pour diffuser une désinformation

Il est révolu le temps où le Web était dominé par les humains qui publient des mises à jour des médias sociaux ou échangeant des mèmes. Plus tôt cette année, pour la première fois depuis le suivi des données, les robots de navigation Web, plutôt que les humains, ont pris en compte la majeure partie du trafic Web.

Plus de la moitié de ce trafic de bot provient de bots malveillants, les données personnelles ont laissé des données non protégées en ligne, par exemple. Mais une proportion croissante provient des robots envoyés par les sociétés de renseignement artificielles pour recueillir des données pour leurs modèles ou répondre aux invites d'utilisateurs. En effet, ChatGpt-User, un bot alimentant le chatppt d'Openai, est désormais responsable de 6% de tout le trafic Web, tandis que Claudebot, un système automatisé développé par la société AI Anthropic, représente 13%.

Les sociétés d'IA affirment que ces données de données sont essentielles pour maintenir leurs modèles à jour. Les créateurs de contenu se sentent différemment, cependant, voir les robots d'IA comme des outils pour la violation des droits d'auteur à grande échelle. Plus tôt cette année, par exemple, Disney et Universal ont poursuivi la société AI MidJourney, faisant valoir que le générateur d'images de la société technologique plagié des personnages de franchises populaires comme Star Wars et Un moi méprisable.

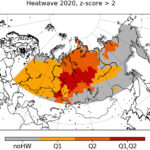

Peu de créateurs de contenu ont l'argent pour des poursuites, donc certains adoptent des méthodes plus radicales pour riposter. Ils utilisent des outils en ligne qui rendent plus difficile pour les robots d'IA de trouver leur contenu – ou qui le manipulent d'une manière qui incite les robots à le jouer mal, afin que l'IA commence à confondre des images de voitures avec des images de vaches, par exemple. Mais bien que cet «empoisonnement en IA» puisse aider les créateurs de contenu à protéger leur travail, il pourrait également faire du Web un endroit plus dangereux.

Violation du droit d'auteur

Pendant des siècles, les copycates ont réalisé un profit rapide en imitant le travail des artistes. C'est une des raisons pour lesquelles nous avons des lois sur la propriété intellectuelle et le droit d'auteur. Mais l'arrivée au cours des dernières années de générateurs d'images de l'IA tels que MidJourney ou Dall-E d'Openai a suralimenté le problème.

Aux États-Unis, une préoccupation centrale est ce que l'on appelle la doctrine de l'utilisation équitable. Cela permet d'utiliser des échantillons de matériel protégé par le droit d'auteur dans certaines conditions sans demander l'autorisation du titulaire du droit d'auteur. La loi sur l'utilisation équitable est délibérément flexible, mais en son cœur est l'idée que vous pouvez utiliser une œuvre originale pour créer quelque chose de nouveau, à condition qu'elle soit suffisamment modifiée et n'a pas d'effet de marché préjudiciable sur l'œuvre originale.

De nombreux artistes, musiciens et autres militants soutiennent que les outils d'IA brouillent la frontière entre l'utilisation équitable et la violation du droit d'auteur au coût des créateurs de contenu. Par exemple, il n'est pas nécessairement préjudiciable pour quelqu'un de dessiner une image de Mickey Mouse dans l'univers des Simpsons pour son propre divertissement. Mais avec l'IA, il est maintenant possible pour quiconque de tourner un grand nombre de telles images rapidement et d'une manière où la nature transformatrice de ce qu'ils ont fait est discutable. Une fois qu'ils ont créé ces images, il serait facile de produire une gamme de t-shirts basés sur eux, par exemple, qui passeraient d'une utilisation personnelle à une utilisation commerciale et à la violation de la doctrine d'utilisation équitable.

Soucieux de protéger leurs intérêts commerciaux, certains créateurs de contenu aux États-Unis prennent une action en justice. Le procès Disney et Universal contre MidJourney, lancé en juin, n'est que le dernier exemple. D'autres incluent une bataille juridique en cours entre Le New York Times et Openai sur une utilisation présumée non autorisée des histoires du journal.

Disney a poursuivi la compagnie AI Midjourney sur son générateur d'images, qu'ils disent plagier les personnages Disney

Les sociétés d'IA nient fortement tout acte répréhensible, insistant sur le fait que le grattage des données est autorisé dans la doctrine de l'utilisation équitable. Dans une lettre ouverte à l'Office américain des sciences et de la technologie technologique en mars, Chris Lehane, directeur des affaires mondiales d'Openai, a averti que les règles rigides du droit d'auteur ailleurs dans le monde, où il y a eu des tentatives de protection plus importante des droits d'auteur pour les créateurs de contenu, «répriment l'innovation et l'investissement». OpenAI a précédemment déclaré qu'il serait «impossible» de développer des modèles d'IA qui répondent aux besoins des gens sans utiliser de travail protégé par le droit d'auteur. Google prend une vue similaire. Dans une lettre ouverte également publiée en mars, la société a déclaré: «Trois domaines de droit peuvent entraver l'accès approprié aux données nécessaires à la formation des modèles de premier plan: le droit d'auteur, la vie privée et les brevets.»

Cependant, au moins pour le moment, il semble que les militants aient la cour de l'opinion publique de leur côté. Lorsque le site IPWatchdog a analysé les réponses publiques à une enquête sur le droit d'auteur et l'IA par le bureau des droits d'auteur américain, il a constaté que 91% des commentaires contenaient des sentiments négatifs sur l'IA.

Ce qui peut ne pas aider les entreprises de l'IA à obtenir de la sympathie publique, c'est un soupçon que leurs bots envoient tellement de trafic vers certains sites Web qu'ils tendent les ressources et peut-être même forçant certains sites Web à se déconnecter – et que les créateurs de contenu sont impuissants à les arrêter. Par exemple, il existe des techniques que les créateurs de contenu peuvent utiliser pour se désinscrire de faire en sorte que les bots aient enveloppé leurs sites Web, y compris la reconfiguration d'un petit fichier au cœur du site Web pour dire que les robots sont interdits. Mais il y a des indications que les robots peuvent parfois ignorer ces demandes et continuer à ramper de toute façon.

Empoisonnement aux données de l'IA

Il n'est donc pas étonnant que de nouveaux outils soient mis à la disposition des créateurs de contenu qui offrent une protection plus forte contre les robots d'IA. Un de ces outils a été lancé cette année par CloudFlare, une entreprise d'infrastructure Internet qui offre à ses utilisateurs une protection contre les attaques de déni de service distribué (DDOS), dans lesquelles un attaquant inonde un serveur Web avec tellement de trafic qu'il fait tomber le site lui-même hors ligne. Pour lutter contre les robots AI qui peuvent poser leur propre risque de type DDOS, Cloudflare combat le feu avec le feu: il produit un labyrinthe de pages générées par l'AIA pleine de contenu non-sens afin que les robots d'IA dépensent tout leur temps et leur énergie en regardant les absurdités, plutôt que les informations réelles qu'ils recherchent.

L'outil, connu sous le nom de Labyrinth AI, est conçu pour piéger les 50 milliards de demandes par jour de Crawlers IA que CloudFlare dit qu'il rencontre sur les sites Web de son réseau. Selon CloudFlare, l'IA Labyrinth devrait «ralentir, confondre et gaspiller les ressources des robots de l'IA et d'autres robots qui ne respectent pas les directives« sans crawl ». CloudFlare a depuis publié un autre outil, qui demande aux entreprises de l'IA de payer pour accéder aux sites Web, ou bien être empêchés de ramper son contenu.

Une alternative consiste à permettre aux robots d'IA l'accès au contenu en ligne – mais à le «empoisonner» subtilement de telle manière qu'il rend les données moins utiles aux fins du bot. Les outils Glaze et Nightshade, développés à l'Université de Chicago, sont devenus centraux de cette forme de résistance. Les deux sont gratuits à télécharger sur le site Web de l'université et peuvent fonctionner sur l'ordinateur d'un utilisateur.

Glaze, sorti en 2022, fonctionne défensivement, appliquant des modifications imperceptibles au niveau des pixels ou des «manteaux de style», à l'œuvre d'un artiste. Ces changements, invisibles pour les humains, amènent les modèles d'IA à mal interpréter le style de l'art. Par exemple, une peinture aquarelle peut être perçue comme une peinture à l'huile. NightShade, publié en 2023, est un outil plus offensant qui empose les données d'image – encore une fois, imperceptiblement en ce qui concerne les humains – d'une manière qui encourage un modèle d'IA à faire une association incorrecte, comme apprendre à relier le mot «chat» avec des images de chiens. Les deux outils ont été téléchargés plus de 10 millions de fois.

L'outil Nightshade empoisonne progressivement les robots de l'AI afin qu'ils représentent les chiens comme des chats

Les outils d'empoisonnement de l'IA remettent le pouvoir entre les mains d'artistes, explique Ben Zhao à l'Université de Chicago, qui est le chercheur principal derrière Glaze et NightShade. «Ce sont des sociétés de capitalisation de marché d'un billion de dollars, littéralement les plus grandes entreprises du monde, prenant par force ce qu'elles veulent», dit-il.

L'utilisation d'outils comme Zhao est un moyen pour les artistes d'exercer le petit pouvoir qu'ils ont sur la façon dont leur travail est utilisé. « Glaze et Nightshade sont des outils vraiment intéressants et sympas qui montrent une méthode d'action soignée qui ne dépend pas des réglementations changeantes, qui peuvent prendre un certain temps et pourraient ne pas être un lieu d'avantage pour les artistes », explique Jacob Hoffman-Andrews à la Fondation Electronic Frontier, un organisme à but non lucratif numérique basé aux États-Unis.

L'idée d'auto-sabotage du contenu pour essayer de conjurer les copies présumées n'est pas nouvelle, explique Eleonora Rosati à l'Université de Stockholm en Suède. «À l'époque, lorsqu'il y avait une grande utilisation non autorisée des bases de données – des répertoires téléphoniques aux listes de brevets – il a été conseillé de consacrer des erreurs pour vous aider en termes de preuves», dit-elle. Par exemple, un cartographe peut inclure délibérément de faux noms de lieux sur leurs cartes. Si ces faux noms apparaissent alors plus tard dans une carte produite par un rival, cela fournirait une preuve claire du plagiat. La pratique fait toujours les gros titres aujourd'hui: le site de paroles de la musique Genius a affirmé avoir inséré différents types d'apostrophes dans son contenu, ce qui, selon Google, avait montré que Google avait utilisé son contenu sans autorisation. Google nie les allégations et une affaire judiciaire déposée par Genius contre Google a été rejetée.

Même l'appeler «sabotage» est discutable, selon Hoffman-Andrews. «Je ne le considère pas nécessairement comme un sabotage», dit-il. «Ce sont les propres images de l'artiste auxquelles ils appliquent leurs propres modifications. Ils sont entièrement libres de faire ce qu'ils veulent avec leurs données.»

On ne sait pas dans quelle mesure les entreprises d'IA prennent leurs propres contre-mesures pour essayer de lutter contre cet empoisonnement du puits, soit en ignorant tout contenu marqué du poison, soit en essayant de les supprimer des données. Mais les tentatives de Zhao de briser son propre système ont montré que Glaze était encore efficace à 85% contre tous les contre-mesures qu'il pouvait penser à prendre, suggérant que les sociétés d'IA pourraient conclure que le traitement des données empoisonnées est plus difficile que cela en vaut la peine.

Répartir les fausses nouvelles

Cependant, ce ne sont pas seulement des artistes contenus pour protéger qui expérimentent l'empoisonnement de l'IA. Certains États-nations peuvent utiliser des principes similaires pour pousser de faux récits. Par exemple, le groupe de réflexion basé aux États-Unis, le Conseil de l'Atlantique, a affirmé plus tôt cette année que le réseau de nouvelles Pravda en Russie – dont le nom signifie «vérité» en russe – a utilisé l'empoisonnement pour inciter les robots d'IA à diffuser de fausses nouvelles.

L'approche de Pravda, comme le prétend le groupe de réflexion, consiste à publier des millions de pages Web, un peu comme le labyrinthe AI de Cloudflare. Mais dans ce cas, le Conseil de l'Atlantique dit que les pages sont conçues pour ressembler à de vrais articles de presse et sont utilisés pour promouvoir le récit du Kremlin sur la guerre de la Russie en Ukraine. Le volume des histoires pourrait conduire des robots de vitesses à sur-insister sur certains récits lorsqu'ils répondent aux utilisateurs, et une analyse publiée cette année par la société de technologie américaine Newsguard, qui suit les activités de Pravda, a révélé que 10 principaux chatbots AI ont publié du texte conformément aux vues de Pravda dans un tiers des cas.

Le succès relatif dans les conversations changeants met en évidence le problème inhérent à tout ce qui concerne l'IA: les astuces technologiques utilisées par les bons acteurs avec de bonnes intentions peuvent toujours être cooptées par de mauvais acteurs avec des objectifs néfastes.

Il y a cependant une solution à ces problèmes, dit Zhao – bien que ce ne soit pas celui que les entreprises de l'IA sont disposées à considérer. Au lieu de rassembler sans discrimination les données qu'ils peuvent trouver en ligne, les entreprises d'IA pourraient conclure des accords formels avec des fournisseurs de contenu légitimes et s'assurer que leurs produits sont formés à l'aide de données fiables. Mais cette approche a un prix, car les accords de licence peuvent être coûteux. «Ces sociétés ne veulent pas licencier les œuvres de ces artistes», explique Zhao. «À l'origine de tout cela, c'est de l'argent.»